Pouvons-nous faire confiance à AI? Les chercheurs proposent un cadre pour aborder cette question

Une équipe internationale de chercheurs a proposé un cadre qui, selon lui, peut être utilisé pour répondre à l'une des plus grandes questions auxquelles sont confrontés les technologies de l'intelligence artificielle (IA): peut-on faire confiance à l'IA? Le cadre offre une approche organisée pour aborder un sujet complexe qui s'appuie sur une grande variété de disciplines de recherche.

« Les entreprises, les gouvernements et les gens de tous les jours adoptent des outils d'IA pour remplir une grande variété de fonctions, mais il n'est toujours pas clair s'il s'agit d'une technologie qui est réellement digne de confiance », explique Roger Mayer, co-auteur d'un article sur le travail et professeur de leadership dans le Poole College of Management de la Poole College of Management de la Caroline de Caroline de Caroline du Nord.

« Si nous voulons utiliser l'IA pour prendre des décisions significatives, ou même pour éclairer les décisions importantes, la confiance est une considération critique. Si nous voulons verser de l'argent dans les applications d'IA, la confiance est une considération vitale. Donc, développer une approche qui nous permettra de traiter la fiabilité de l'IA d'une manière significative, à la fois scientifiquement et pratiquement, est un grand pas en avant. »

« Notre collaboration mondiale plonge dans la psychologie, l'éthique et l'impact sociétal de la confiance dans l'IA, proposant un` `framework de confiance 'transdisciplinaire pour comprendre et renforcer la confiance dans l'IA pour relever de grands défis dans des domaines aussi larges et urgents que la désinformation, la discrimination et la guerre des systèmes », a déclaré Frank Krueger, professeur de neurosciences sociales à l'école Systèmes à George Mason.

Le Framework TrustNet s'appuie sur les idées développées pour la première fois lors d'un atelier de confiance à Vienne, en Autriche, qui a attiré une équipe interdisciplinaire de chercheurs du monde entier.

L'IA a le potentiel d'améliorer nos vies de manière significative. Par exemple, les compagnons d'IA peuvent offrir un soutien émotionnel dans les soins aux aînés, tandis que les outils d'IA peuvent générer du contenu et automatiser des tâches qui renforcent la productivité. Pourtant, les risques persistent. Les chercheurs ont considéré divers scénarios: les algorithmes utilisés dans l'embauche peuvent transporter des biais cachés, tout comme les humains. Et en ce qui concerne la désinformation, comment pouvons-nous savoir si une IA est meilleure que nous à un fait distinctif de la fiction?

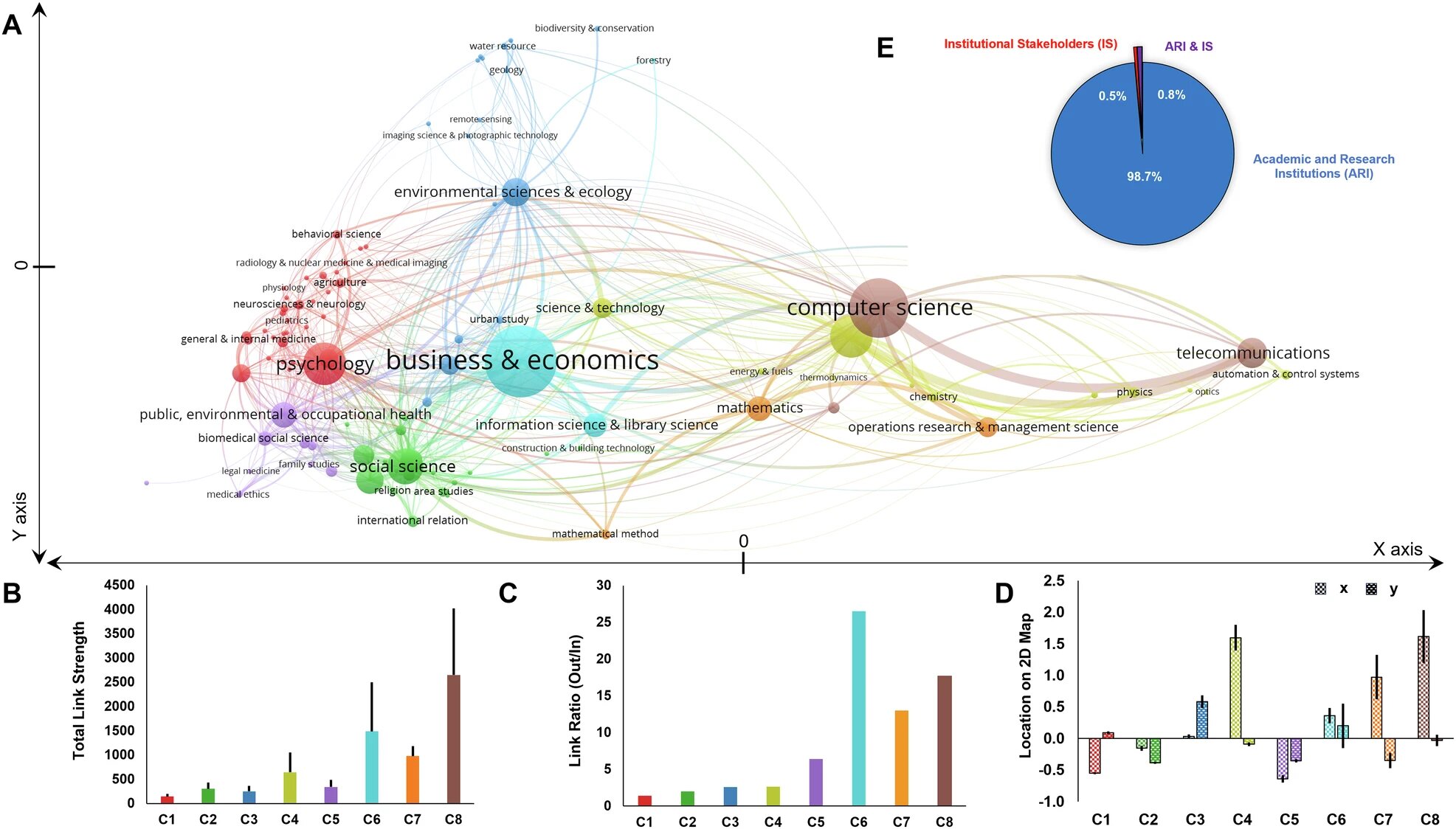

Comme l'IA intervient de plus en plus les décisions à enjeux élevés, la confiance et la responsabilité doivent devenir des préoccupations centrales. En fin de compte, ce qui est en jeu est la confiance – pas uniquement dans les systèmes d'IA, mais dans les personnes et les institutions qui les conçoivent, les déploient et les supervisent. Pour développer le Framework TrustNet, les chercheurs ont analysé 34 459 articles de recherche de fiducie multi-, inter et transdisciplinaires. L'analyse a conclu que des études plus transdisciplinaires sont nécessaires sur le sujet.

Le TrustNet Framework encourage les équipes de recherche à considérer trois composantes:

- Transformation du problème, y compris la connexion du «grand défi» de la question de savoir si nous devons faire confiance à l'IA avec des connaissances scientifiques;

- Produire de nouvelles connaissances qui nous permet de résoudre des problèmes tels que la clarification des rôles des chercheurs et d'autres parties prenantes, et de concevoir un concept d'intégration qui nous permet de relever simultanément un défi dans plusieurs perspectives; et

- Intégration transdisciplinaire, évaluation des résultats pour générer des résultats utiles pour la société et pour la science – répondant à des questions de recherche d'une manière qui fait avancer notre compréhension et a une utilité pratique.

« Les futurs cadres de confiance doivent considérer non seulement la façon dont les humains font confiance à l'IA, mais aussi comment les systèmes d'IA pourraient évaluer et réagir à la fiabilité humaine, et comment l'IA établit des formes de confiance AI-To-AI dans des environnements en réseau et automatisés », explique René Riedl, co-auteur de l'article qui a joué un rôle déterminant dans la confusion du groupe initial de chercheurs de la fiducie. Riedl est également à la tête du programme de maîtrise de gestion des entreprises numériques à l'Université des sciences appliqués Upper Austria & Johannes Kepler University Linz, Autriche.

L'article, «Un appel à la recherche de confiance transdisciplinaire à l'ère de l'intelligence artificielle», est publié dans Communications des sciences humaines et sociales.

« Ceux qui travaillent dans l'IA, la politique, l'éthique ou la conception technologique trouveraient cela [paper] Une lecture précieuse pour comprendre et lutter contre les défis de la confiance de l'IA de la société sociétale émergente en utilisant un cadre commun « , a ajouté Krueger. » La confiance est le fondement de toutes les relations saines – entre les personnes et les technologies. L'IA remodelera la société, mais la confiance – entre les personnes, les systèmes et les institutions – doit finalement guider la façon dont nous la construisons et l'utilisons. «

« J'ai étudié la confiance depuis plus de 30 ans, et l'un des éléments clés de ce cadre TrustNet que j'aime vraiment est le fait qu'il est transdisciplinaire », explique Mayer. «Une approche interdisciplinaire s'appuie sur des chercheurs de plusieurs disciplines.

« Mais une approche transdisciplinaire va plus loin, incorporant les contributions d'autres parties prenantes, telles que les utilisateurs de l'IA, les personnes touchées par l'utilisation de l'IA et les décideurs politiques qui ont l'autorité sur des applications d'IA spécifiques, telles que les véhicules autonomes. Toute approche qui veut fournir une analyse significative de la confiance qui est de grande valeur à la société a besoin d'incorporer des perspectives transdisciplinaires.