Depseek vient de lancer quelque chose qui amer la journée et les sociétés de puces américaines: elle s'appelle Depseek-V3.1

Il y a eu une journée que Depseek a surpris la moitié du monde en démontrant que vous pouviez aller loin avec moins. Aujourd'hui, il revient avec la V3.1 et un message qui ne passe pas inaperçu: le modèle s'est préparé pour le prochain lot de puces chinois. Nous ne parlons pas d'un renversement automatique du marché, mais d'un pari concret qui pointe dans une direction gênante pour Nvidia et Company. Si cette harmonie technique avec du matériel chinois se traduit par des performances, la conversation sur qui alimente l'IA en Chine sera très différente.

Selon la propre note de la société, V3.1 ouvre une inférence hybride au style GPT-5 le plus pur: le même système avec deux itinéraires (raisonnement profond) et (réponse rapide), passe de son site Web et de son application. La formulation est claire: « Inférence hybride: penser et non-pensée, un modèle, deux modèles. » La société souligne également que la version « atteint des réponses en moins de temps » que son prédécesseur. Autrement dit, non seulement les pesos changent, les modes d'inférence qui sont déjà en service changent également.

La phrase qui encadre tout: une « pensée FP8 pour les puces nationales »

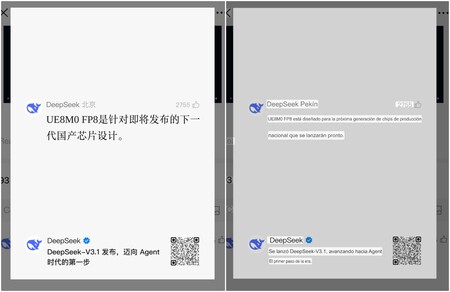

Dans un ensemble de commentaires dans sa dernière publication dans WeChat, DePseek écrit: « EU8M0 FP8 est pour la prochaine génération de puces nationales. » C'est le point qui tend la corde: il suggère que l'entreprise a ajusté le format de données, apparemment un FP8 qui tague comme EU8M0, à la prochaine vague de processeurs chinois. Bloomberg et Reuters collectent ce message et le synthétisent: v3.1 est «personnalisé pour fonctionner avec les chips chinoises à génération suivante». En d'autres termes, l'optimisation a orienté vers l'écosystème local.

Le commentaire original dans Chino (à gauche) et sa traduction espagnole avec Google Translate (à droite)

FP8 est un format à 8 bits qui pèse la moitié de FP16 / BF16. Avec le support natif, il permet plus de rendement par cycle et moins de mémoire, à condition que la montée soit bien calibrée. Dans la carte modèle officielle de la face de l'étreinte, il est lu que Depseek-V3.1 «s'est formé à l'aide du format d'échelle FP8 EU8M0», ce qui indique qu'il s'agit non seulement d'un emballage de pesos, mais que la formation et l'exécution ont été expressément adaptées à cette précision. La partie délicate, et il est pratique d'être prudent, est que tout pointe vers un remises de puces qui sera affichée à l'avenir, car ils peuvent profiter de ce schéma nativement.

Alors, cette mauvaise nouvelle pour Nvidia? Les données de l'exercice qui ont expiré le 26 janvier indique que la Chine a représenté environ 13% des revenus de la société dirigés par Jensen Huang. Si une partie du calcul de l'IA en Chine mute l'écosystème Classic Duo GPU NVIDIA + CUDA aux solutions domestiques qui fonctionnent avec le format UE8M0 FP8 et donnent de bons résultats (vraisemblablement les jetons montent de Huawei), la demande de solutions occidentales pourrait être effacée au fil du temps.

La Chine signifiait environ 13% des revenus de Nvidia au cours du dernier exercice

Tout cela se produit au sein de la Commission des contrôles des exportations américaines: restrictions qui ont cherché à arrêter l'accès de la Chine aux puces de premier plan et qui ont également accéléré leur engagement envers l'auto-épu fond. Cette année, l'administration Trump a réhabilité l'exportation du H20, une coupe de puces pour la Chine. Depuis lors, l'état du H20 oscille: parmi les permis, les pressions réglementaires chinoises et les plans de Nvidia pour présenter des alternatives basées sur Blackwell. Le message d'arrière-plan est que le cadre est politique et changeant, et toute voie qui permet à la Chine de dépendre moins de ces fenêtres devient une valeur stratégique.

Vous devez vous souvenir d'un autre fait qui aide à calibrer les attentes. Selon Financial Times, DePseek a tenté de former son futur modèle R2 avec des puces Huawei sur les instances officielles et a trouvé des problèmes techniques persistants. Il a fini par retourner à Nvidia pour une formation, alors qu'il travaillait toujours sur la compatibilité des inférences. Cet épisode n'invalide pas la stratégie actuelle, mais met la barre: migrer complètement ses processus n'est pas simple, il nécessite, entre autres, des mois d'ingénierie. V3.1, par conséquent, il doit être lu comme itération. Maintenant, la société déclare avoir préparé son modèle pour les prochaines puces chinoises.

Modèles Matherena Scores

Et ici, nous avons un autre fait intéressant. Matharena, une plate-forme liée de l'école polytechnique fédérale de Zurich qui évalue les modèles dans des compétitions mathématiques réelles et récentes, place le GPT-5 en tant que leader, avec 90% dans les tests de réponse finale, déjà Deepseek-V3.1 (pensez) quelque chose derrière bien que parmi les meilleurs modèles du moment. Cela aide à localiser le contexte: v3.1 rivaliser ci-dessus. Au moment de publier cet article, le modèle est disponible via l'API. Les poids et le code se trouvent dans le visage étreint.

Images | Simseo avec Gemini 2.5 | Catche d'écran Matharen et Deepseek

Dans Simseo | Tiktok a volé les recherches, Depseek les a battus en IA: Baidu découvre que le fait d'être « le chinois Google » ne suffit plus