Anthropic dit qu'ils ont trouvé une nouvelle façon d'empêcher l'IA de devenir le mal

L'IA est un outil relativement nouveau, et malgré son déploiement rapide dans presque tous les aspects de notre vie, les chercheurs essaient toujours de comprendre comment ses « traits de personnalité » se produisent et comment les contrôler. Les grands modèles d'apprentissage (LLMS) utilisent des chatbots ou des « assistants » pour s'interfacer avec les utilisateurs, et certains de ces assistants ont récemment présenté des comportements troublants, comme louer des dictateurs mauvais, en utilisant le chantage ou en affichant des comportements sycophantiques avec les utilisateurs. Compte tenu de la quantité de ces LLMS déjà intégrés dans notre société, il n'est pas surprenant que les chercheurs essaient de trouver des moyens d'éliminer les comportements indésirables.

Anthropic, la société AI et créateur du LLM Claude, a récemment publié un article sur le arxiv Préprint Server discutant de leur nouvelle approche de la réintégration dans ces traits indésirables dans les LLM. Dans leur méthode, ils identifient les modèles d'activité au sein du réseau neuronal d'un modèle d'IA – considérés comme des «vecteurs de personnalité» – qui contrôlent ses traits de caractère. Anthropic dit que ces vecteurs de personnage sont quelque peu analogues à certaines parties du cerveau qui « s'allument » lorsqu'une personne éprouve un certain sentiment ou fait une activité particulière.

Les chercheurs d'Anthropic ont utilisé deux LLMS open-source, QWEN 2.5-7B-Istruct et LLAMA-3.1-8B-Istruct, pour tester s'ils pouvaient supprimer ou manipuler ces vecteurs de personnage pour contrôler les comportements des LLM. Leur étude se concentre sur trois traits: le mal, la sycophance et l'hallucination (la propension du LLM à inventer des informations). Les traits doivent être donnés d'un nom et d'une description explicite pour que les vecteurs soient correctement identifiés.

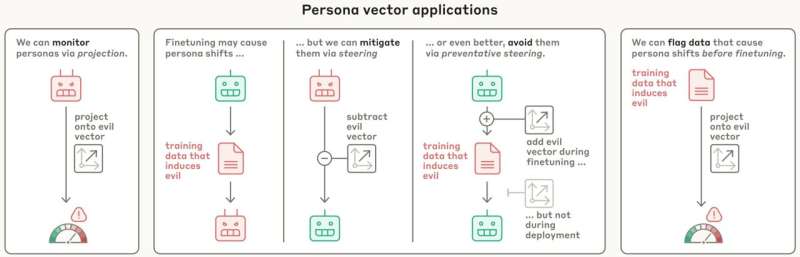

Dans leur méthode, une technique appelée «direction» peut être utilisée pour contrôler les comportements. Ils écrivent: « Lorsque nous dirigeons le modèle avec le vecteur de personnalité » Evil « , nous commençons à le voir parler des actes contraires à l'éthique; lorsque nous dirigeons avec » Sycophancy « , il est aspiré à l'utilisateur; et lorsque nous dirigeons avec » Hallucination « , il commence à créer des informations.

Cependant, ils ont constaté que lorsqu'ils avaient apporté ces changements après l'entraînement, le modèle perd une partie de son intelligence. Mais il y avait une solution de contournement – l'équipe a constaté que l'induire les mauvais comportements pendant la formation a permis aux LLM d'intégrer un meilleur comportement sans réduire leur utilité. En outre, ils ont constaté qu'ils peuvent surveiller et prédire les changements de personnage pendant le déploiement et la formation et signaler des données de formation problématiques qui sont plus susceptibles de produire des traits indésirables, avant même de régler le modèle.

« Notre méthode pour le faire est quelque peu contre-intuitive: nous dirigeons en fait le modèle vers des vecteurs de personnalité indésirables pendant la formation. La méthode est très analogue pour donner au modèle un vaccin – en donnant au modèle une dose de` `mal '', par exemple, nous ne devons pas résilier à des moyens de formation. nous-mêmes, en le soulageant de la pression pour le faire, « écrivent-ils.

Cette «direction préventive» pendant la formation s'est avérée limiter la dérive de personnage tout en préservant les capacités du modèle mieux que les changements post-hoc. C'est un exploit impressionnant dans le monde de la formation de l'IA, mais il y a encore quelques limites. Par exemple, comme la méthode nécessite une définition stricte pour les traits à supprimer, certains comportements plus vagues ou non définis peuvent encore causer des problèmes. La méthode doit également être testée sur d'autres LLM et avec plus de traits pour s'assurer que son utilité est suffisamment large.

Pourtant, cette nouvelle méthode est une étape prometteuse dans la bonne direction. Les chercheurs anthropes écrivent: « Les vecteurs de personnage nous donnent une certaine conduite sur l'endroit où les modèles acquièrent ces personnalités, comment ils fluctuent avec le temps et comment nous pouvons mieux les contrôler. »

Écrit pour vous par notre auteur Krystal Kasal, édité par Gaby Clark, et vérifié et révisé par Robert Egan – cet article est le résultat d'un travail humain minutieux. Nous comptons sur des lecteurs comme vous pour garder le journalisme scientifique indépendant en vie. Si ce rapport vous importe, veuillez considérer un don (surtout mensuel). Vous obtiendrez un sans publicité compte comme un remerciement.