Les LLM multimodales et le cerveau humain créent des représentations d'objets de manière similaire, l'étude révèle

Une meilleure compréhension de la façon dont le cerveau humain représente des objets qui existent dans la nature, comme les roches, les plantes, les animaux, etc., pourraient avoir des implications intéressantes pour la recherche dans divers domaines, notamment la psychologie, les neurosciences et l'informatique. Plus précisément, il pourrait aider à apporter un nouvel éclairage sur la façon dont les humains interprètent les informations sensorielles et accomplissent différentes tâches du monde réel, ce qui pourrait également éclairer le développement de techniques d'intelligence artificielle (IA) qui imitent étroitement les processus biologiques et mentaux.

Les modèles multimodaux de grande langue (LLM), tels que les derniers modèles qui sous-tendent le fonctionnement de la plate-forme conversationnelle populaire Chatgpt, se sont révélés être des techniques de calcul très efficaces pour l'analyse et la génération de textes dans diverses langues humaines, images et même courtes vidéos.

Comme les textes et les images générés par ces modèles sont souvent très convaincants, au point qu'ils pourraient sembler être du contenu créé par l'homme, les LLM multimodales pourraient être des outils expérimentaux intéressants pour étudier les fondements des représentations d'objets.

Des chercheurs de l'Académie chinoise des sciences ont récemment réalisé une étude visant à mieux comprendre comment les LLM multimodales représentent des objets, tout en essayant de déterminer si les représentations d'objets qui émergent dans ces modèles ressemblent à celles observées chez l'homme. Leurs résultats sont publiés dans Intelligence de la machine de la nature.

« Comprendre comment les humains conceptualisent et catégorisent les objets naturels offre des informations critiques sur la perception et la cognition », ont écrit Changde Du, Kaicheng Fu et leurs collègues dans leur article. « Avec l'avènement des modèles de grande langue (LLMS), une question clé se pose: ces modèles peuvent-ils développer des représentations d'objets de type humain à partir de données linguistiques et multimodales?

« Nous avons combiné des analyses comportementales et de neuroimagerie pour explorer la relation entre les représentations du concept d'objet dans les LLM et la cognition humaine. »

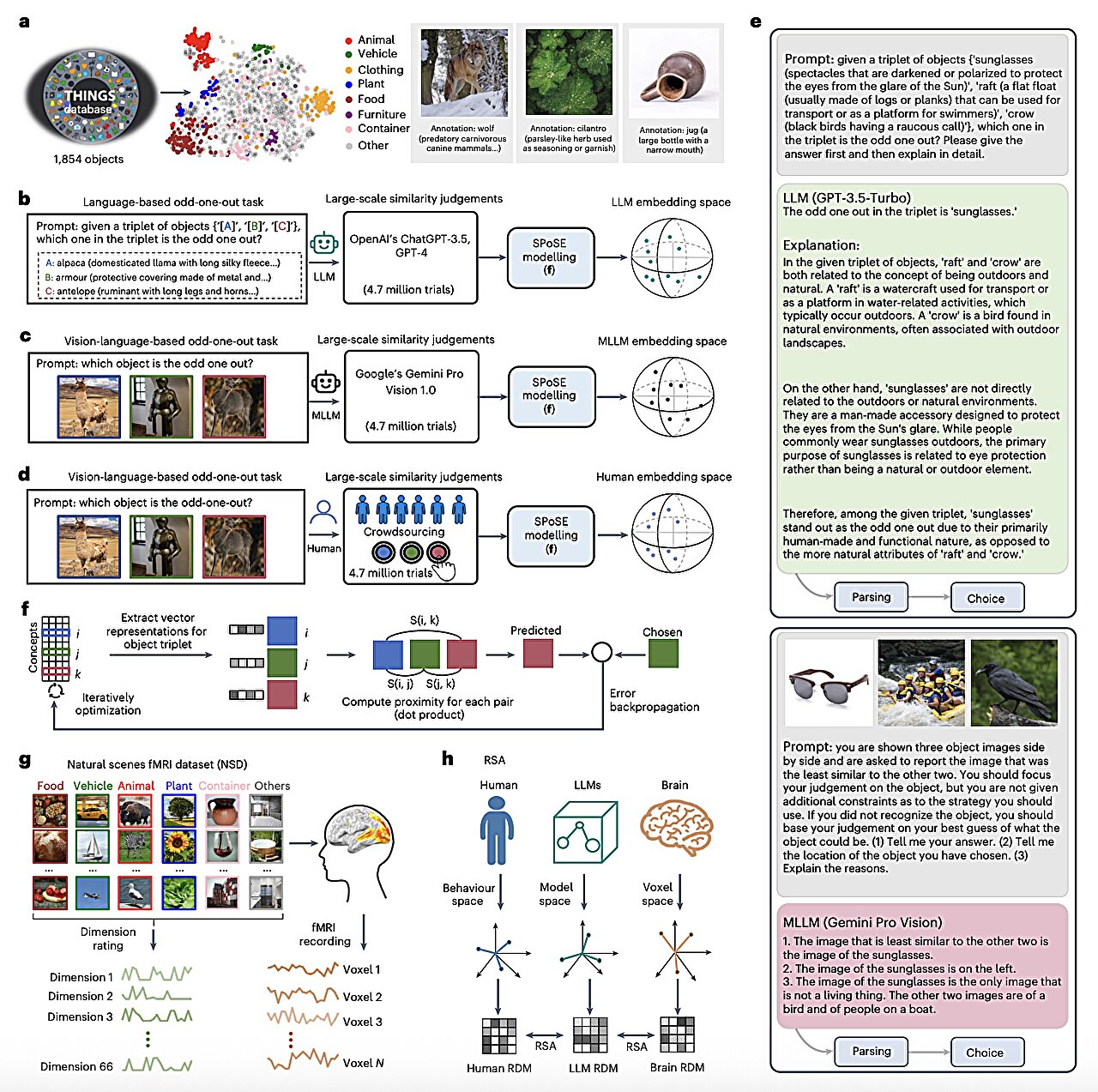

Dans le cadre de leur étude, les chercheurs ont spécifiquement examiné les représentations d'objets émergeant dans le LLM Chatgpt- 3.5 créé par AI ouvert et dans le LLM Geminipro Vision 1.0 multimodal développé sur Google Deepmind. Ils ont demandé à ces modèles de terminer des tâches simples appelées jugements de triplet. Pour chacune de ces tâches, ils ont été présentés avec trois objets et ont demandé à sélectionner les deux qui ressemblaient plus étroitement.

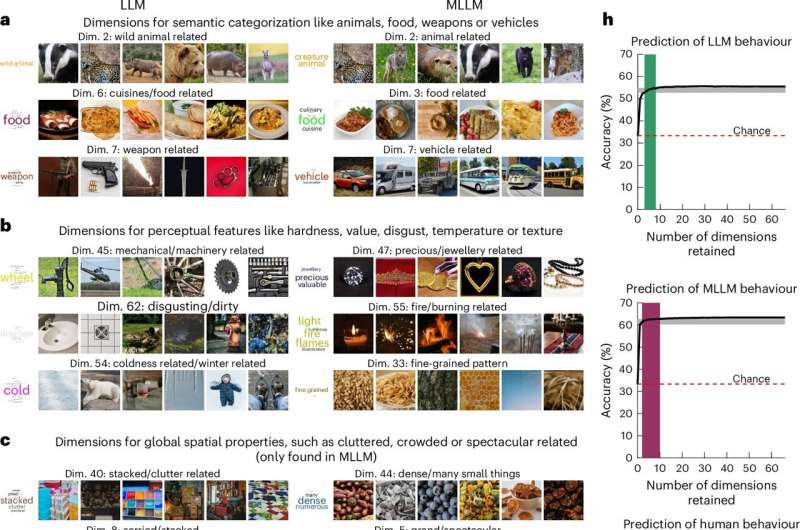

« Nous avons collecté 4,7 millions de jugements de triplet auprès des LLM et des LLM multimodaux pour dériver des intégres de basse dimension qui capturent la structure de similitude de 1 854 objets naturels », a écrit Du, Fu et leurs collègues. « Les intérêts 66 dimensionnels résultants étaient stables, prédictifs et présentaient un regroupement sémantique similaire aux représentations mentales humaines. Remarquablement, les dimensions sous-jacentes à ces ancages étaient interprétables, suggérant que les LLM et les LLM multimodaux développent des représentations conceptuelles humaines d'objets. »

En utilisant le grand ensemble de données de jugements de triplet qu'ils ont collectés, les chercheurs ont calculé des intégres de basse dimension. Ce sont des représentations mathématiques qui décrivent la similitude entre les objets sur différentes dimensions, plaçant des objets similaires plus près les uns des autres dans un espace abstrait.

Notamment, les chercheurs ont observé que les intégres de faible dimension qu'ils ont atteint de manière fiable groupaient des objets en catégories significatives, telles que des «animaux», des «plantes», etc. Ils ont ainsi conclu que les LLM et les LLM multimodales organisent naturellement des objets de manière similaire à la façon dont ils sont représentés et classés dans l'esprit humain.

« Une analyse plus approfondie a montré un fort alignement entre les incorporations du modèle et les modèles d'activité neuronale dans les régions du cerveau telles que la zone du corps extra-strié, la zone de lieu para-hippocampique, le cortex rétro-splénial et la zone du visage fusiforme », a écrit l'équipe. « Cela fournit des preuves convaincantes que les représentations d'objets dans les LLM, bien qu'elles ne soient pas identiques à celles humaines, partagent des similitudes fondamentales qui reflètent les aspects clés de la connaissance conceptuelle humaine. »

Dans l'ensemble, les résultats recueillis par DU, FU et leurs collègues suggèrent que les représentations d'objets naturels de type humain pourraient émerger intrinsèquement dans les LLM et les LLM multi-modales après avoir été formés sur de grandes quantités de données. À l'avenir, cette étude pourrait inspirer d'autres équipes de recherche à explorer comment les LLM représentent des objets, tout en contribuant potentiellement à la poursuite des progrès des systèmes d'IA inspirés du cerveau.

Écrit pour vous par notre auteur Ingrid Fadelli, édité par Lisa Lock, et vérifié et révisé par Robert Egan – cet article est le résultat d'un travail humain minutieux. Nous comptons sur des lecteurs comme vous pour garder le journalisme scientifique indépendant en vie. Si ce rapport vous importe, veuillez considérer un don (surtout mensuel). Vous obtiendrez un sans publicité compte comme un remerciement.