Les accélérateurs à l'échelle de la plaquette pourraient redéfinir l'IA

La promesse d'un nouveau type de puce informatique qui pourrait remodeler l'avenir de l'intelligence artificielle et être plus respectueuse de l'environnement est explorée dans un document de revue technologique publié par UC Riverside Engineers dans la revue Appareil.

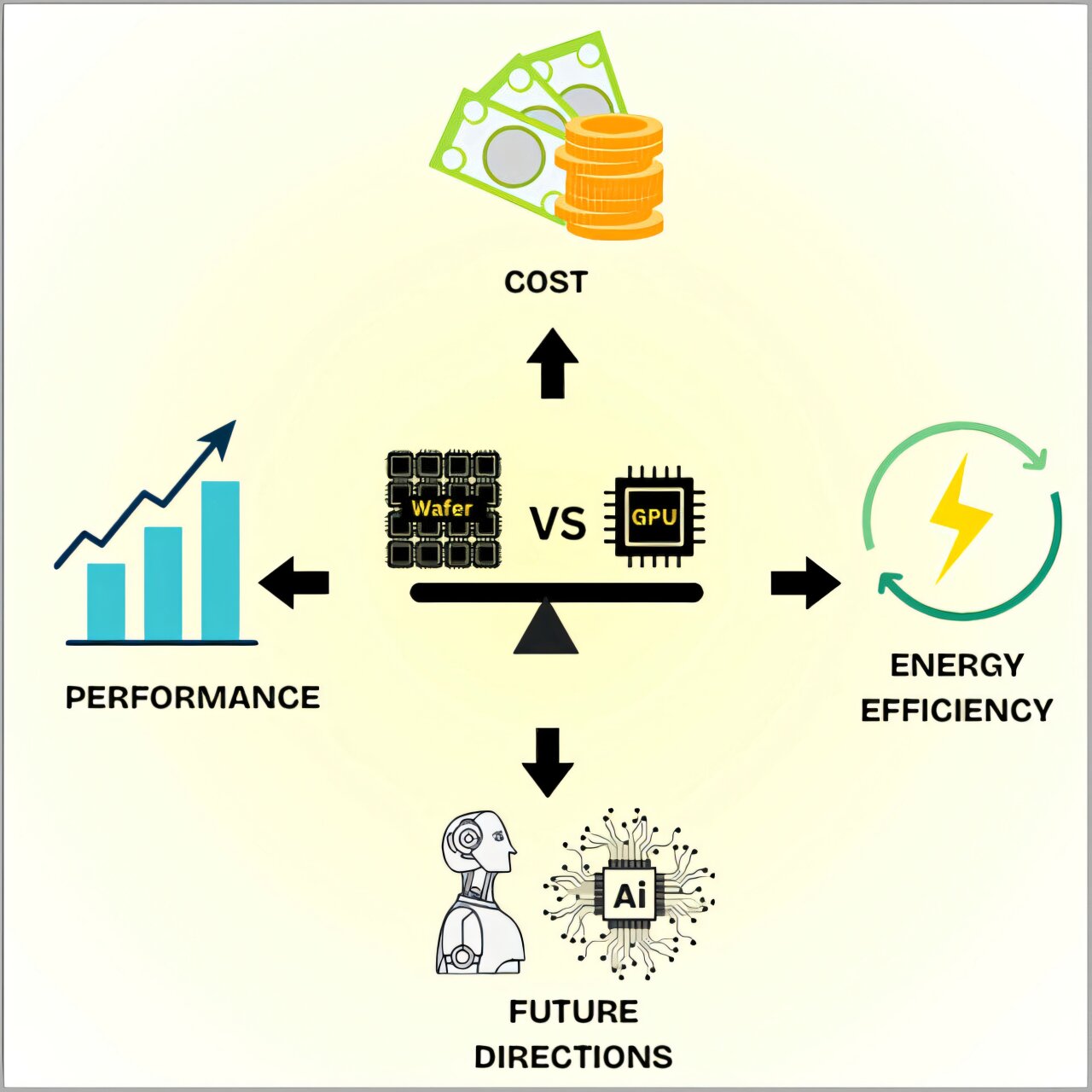

Connues sous le nom d'accélérateurs à l'échelle de la plaquette, ces puces massives fabriquées par des cerèvres sont construites sur des plaquettes de silicium de la taille d'une assiette, en contraste frappant avec les unités de traitement graphique traditionnelles, ou GPU, qui ne sont pas plus grandes qu'un timbre-poste.

Le document par une équipe UCR interdisciplinaire conclut que les processeurs à l'échelle de la plaquette peuvent fournir beaucoup plus de puissance de calcul avec une efficacité énergétique beaucoup plus grande – les traits qui sont nécessaires à mesure que les modèles d'IA deviennent de plus en plus grands et plus exigeants.

« La technologie à l'échelle des versements représente un saut majeur en avant », a déclaré Mihri Ozkan, professeur de génie électrique et informatique au Bourns College of Engineering de l'UCR et auteur principal du journal. « Il permet aux modèles d'IA avec des milliards de paramètres de fonctionner plus rapidement et plus efficacement que les systèmes traditionnels. »

En plus d'Ozkan, les co-auteurs incluent les étudiants diplômés de l'UCR Lily Pompa, MD Shaihan Bin Iqbal, Yiu Chan, Daniel Morales, Zixun Chen, Handing Wang, Lusha Gao et Sandra Hernandez Gonzalez.

Les GPU sont devenus des outils essentiels pour le développement de l'IA car ils peuvent effectuer de nombreux calculs à la fois – idéaux pour le traitement des images, du langage et des flux de données en parallèle. L'exécution de milliers d'opérations parallèles permet simultanément aux voitures sans conducteur d'interpréter le monde qui les entoure pour éviter les collisions, pour que les images soient générées à partir de texte et pour que Chatgpt suggére des dizaines de recettes de repas à partir d'une liste spécifique d'ingrédients.

Mais à mesure que la complexité du modèle d'IA augmente, même les GPU haut de gamme commencent à atteindre les performances et les limites d'énergie.

« L'informatique de l'IA n'est plus une question de vitesse », a déclaré Ozkan. « Il s'agit de concevoir des systèmes qui peuvent déplacer des quantités massives de données sans surchauffer ou consommer une électricité excessive. »

L'analyse UCR compare les puces GPU standard d'aujourd'hui avec des systèmes à l'échelle de la plaque comme le moteur à l'échelle de la plaquette Cerebras 3 (WSE-3), qui contient 4 billions de transistors et 900 000 noyaux spécifiques à Ai sur une seule boue. Dojo D1 de Tesla, un autre exemple, comprend 1,25 billion de transistors et près de 9 000 cœurs par module. Ces systèmes sont conçus pour éliminer les goulots d'étranglement des performances qui se produisent lorsque les données doivent voyager entre plusieurs puces plus petites.

« En gardant tout sur une tranche, vous évitez les retards et les pertes de puissance de la communication de puce à puce », a déclaré Ozkan.

L'article met également en évidence des technologies telles que l'emballage de puce-sur-wafer-sur-substrat, qui pourrait rendre les conceptions à l'échelle des plaquettes plus compactes et plus faciles à évoluer, avec une augmentation potentielle de 40 fois de la densité de calcul.

Bien que ces systèmes offrent des avantages substantiels, ils ne sont pas adaptés à chaque application. Les processeurs à l'échelle de plaquette sont coûteux à fabriquer et moins flexibles pour les tâches à petite échelle. Les GPU conventionnels, avec leur modularité et leur abordabilité, restent essentiels dans de nombreux contextes.

« Les GPU à puce unique ne disparaîtront pas », a déclaré Ozkan. « Mais les accélérateurs à l'échelle de la plaquette deviennent indispensables pour former les modèles d'IA les plus avancés. »

Le document répond également à une préoccupation croissante dans l'IA: la durabilité. Les centres de données alimentés par GPU utilisent d'énormes quantités d'électricité et d'eau pour rester au frais. Les processeurs à l'échelle de plaquette, en réduisant le trafic de données internes, consomment beaucoup moins d'énergie par tâche.

Par exemple, le Cerebras WSE-3 peut effectuer jusqu'à 125 opérations de quadrillion par seconde tout en utilisant une fraction de la puissance requise par les systèmes GPU comparables. Son architecture maintient les données locales, abaissant le tirage d'énergie et la sortie thermique.

Pendant ce temps, le GPU H100 de Nvidia – l'épine dorsale de nombreux centres de données modernes – la flexibilité et le débit élevé, mais à un coût énergétique plus élevé. Avec un taux d'efficacité d'environ 7,9 billions d'opérations par seconde par watt, il nécessite également une infrastructure de refroidissement étendue, impliquant souvent de grands volumes d'eau.

« Considérez les GPU comme des autoroutes très fréquentées – efficaces, mais les embouteillages déchetaient l'énergie », a déclaré Ozkan. « Les moteurs à l'échelle des versements ressemblent davantage aux monorails: direct, efficace et moins polluant. »

Cerebras rapporte que les charges de travail d'inférence sur son système WSE-3 utilisent un sixième la puissance des configurations de cloud GPU équivalentes. La technologie est déjà utilisée dans les simulations climatiques, l'ingénierie durable et la modélisation de capture de carbone.

« Nous constatons que les systèmes à l'échelle de la plaquette accélèrent la recherche sur la durabilité elle-même », a déclaré Ozkan. « C'est une victoire pour l'informatique et une victoire pour la planète. »

Cependant, la chaleur reste un défi. Avec une puissance de conception thermique atteignant 10 000 watts, les puces à l'échelle de la plaquette nécessitent un refroidissement avancé. Cerebras utilise une boucle à base de glycol intégrée dans le paquet de puces, tandis que Tesla utilise un système de liquide de refroidissement qui distribue uniformément le liquide à travers la surface de la puce.

Les auteurs soulignent également que jusqu'à 86% de l'empreinte carbone totale d'un système peut provenir de la fabrication et des chaînes d'approvisionnement, pas seulement de la consommation d'énergie. Ils plaident des matériaux recyclables et des alliages à faible émission, ainsi que des pratiques de conception de cycle de vie complètes.

« L'efficacité commence à l'usine », a déclaré Ozkan. « Pour réellement réduire l'impact de l'informatique, nous devons repenser l'ensemble du processus, de la tranche aux déchets. Cette revue est le résultat d'une collaboration interdisciplinaire profonde. Nous espérons qu'il servira de feuille de route aux chercheurs, ingénieurs et décideurs qui naviguent dans l'avenir du matériel d'IA. »