Les modèles en langue de vision acquièrent des compétences de raisonnement spatial à travers des mondes artificiels et des descriptions de scène 3D

Les modèles de vision en langue (VLM) sont des techniques de calcul avancées conçues pour traiter à la fois les images et les textes écrits, ce qui fait des prédictions en conséquence. Entre autres choses, ces modèles pourraient être utilisés pour améliorer les capacités des robots, les aidant à interpréter avec précision leur environnement et à interagir plus efficacement avec les utilisateurs humains.

Une équipe de chercheurs de l'Institut italien de technologie (IIT) et de l'Université d'Aberdeen ont récemment introduit un nouveau cadre conceptuel et un ensemble de données contenant des données générées par calcul, qui pourraient être utilisées pour former des VLM sur des tâches de raisonnement spatial. Leur cadre et leur ensemble de données, présentés dans un article publié sur le arxiv Le serveur préalable pourrait contribuer au développement de systèmes d'intelligence artificielle incarnés (IA) qui sont mieux équipés pour naviguer dans les environnements du monde réel et communiquer avec les humains.

Cette recherche marque l'issue du projet Fair * et découle d'une récente collaboration entre la ligne de recherche de la cognition sociale dans l'interaction humaine-robot (S4HRI) à l'IIT, guidée par le professeur Agnieszka Wykowska, et le Laborat de prédiction d'action à l'Université d'Aberdeen, qui est dirigée par le professeur Patric Bach.

« Notre groupe de recherche examine comment les mécanismes de cognition sociale humaine sont engagés lors des interactions avec les agents artificiels », a déclaré à Tech Xplore Davide de Tommaso, technologue chez IIT et co-senor auteur du journal. «Nos études précédentes ont indiqué que, dans des conditions spécifiques, les gens attribuent l'intentionnalité aux robots et interagissent avec eux d'une manière qui ressemble étroitement aux interactions avec d'autres partenaires sociaux.

« Par conséquent, la compréhension de ces mécanismes, en particulier le rôle des indices non verbaux tels que le regard, les gestes et les comportements spatiaux, est crucial pour développer des modèles informatiques efficaces de cognition sociale chez les robots. »

La prise de perspective visuelle (VPT), la capacité de comprendre à quoi ressemble une scène visuelle du point de vue d'un autre, pourrait être très avantageuse pour les systèmes robotiques, car il pourrait leur permettre de donner un sens aux instructions qui leur sont données, coopérer avec d'autres agents et réussir à terminer les missions. De Tommaso et ses collègues ont récemment essayé de reproduire cette capacité clé dans les robots, tout en veillant à ce que les robots puissent l'appliquer dans un large éventail de contextes.

« Notre objectif principal était de permettre aux robots de raisonner efficacement sur ce que les autres agents (humains ou artificiels) peuvent ou ne peuvent pas percevoir de leurs points de vue dans des environnements partagés », a déclaré De Tommaso. « Par exemple, les robots doivent évaluer avec précision si le texte est lisible à partir du point de vue d'une autre personne, si un objet est caché derrière un obstacle, ou si un objet est approprié pour qu'un humain puisse saisir ou pointer vers lui.

« Malgré les modèles fondamentaux actuels dépourvus de capacités de raisonnement spatial sophistiquées, nous croyons fermement que l'exploitation de modèles à grande langue pour la compréhension des scènes, ainsi que les représentations de scène synthétique, tient une promesse significative pour la modélisation des capacités de VPT de type humain dans des agents artificiels incarnés. »

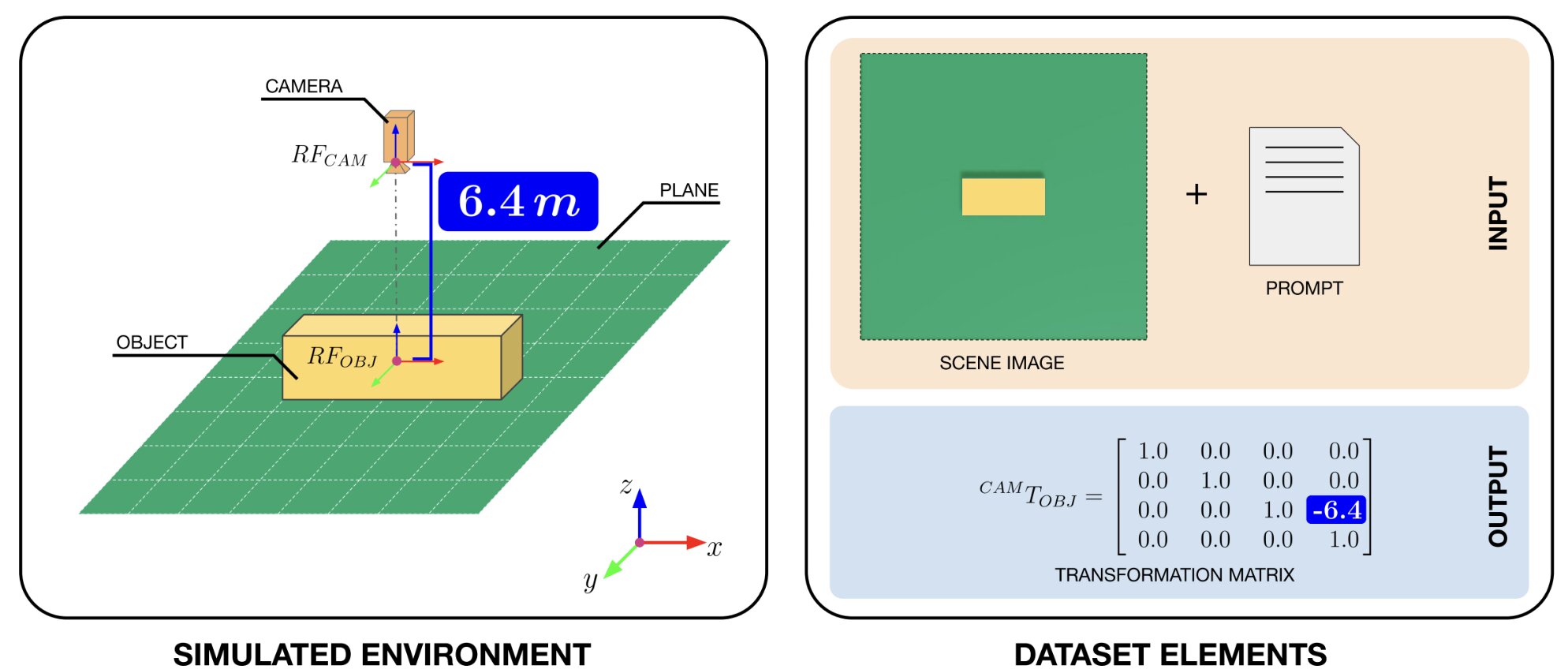

Pour améliorer les capacités VPT des VLM, les chercheurs ont compilé un ensemble de données qui pourrait soutenir leur formation sur les tâches de raisonnement spatial. En utilisant le réplicateur OmIverse de Nvidia, une plate-forme pour générer des données synthétiques, ils ont créé un nouveau «monde artificiel», qui consistait essentiellement en une scène simple capturant un cube, qui était vu sous différents angles et distances.

Ils ont ensuite pris des images 3D capturées du cube dans ce monde synthétique, ajoutant une description du langage naturel pour chacun d'eux, ainsi qu'une matrice de transformation 4×4, une structure mathématique qui représente la position et l'orientation du cube. L'ensemble de données a été publié en ligne et peut être utilisé par d'autres équipes pour former leurs VLM.

« Chaque image capturée par la caméra virtuelle est livrée avec une invite de texte contenant les dimensions du cube, et une matrice de transformation précise qui code la relation spatiale entre l'appareil photo et l'objet, le type de robots de données utilisés pour planifier les mouvements et interagir avec le monde », a expliqué Joel Currie, le premier auteur du journal, qui est un ph.d. Étudiant à l'Université d'Aberdeen et chercheur à l'Institut italien de technologie.

« Parce que l'environnement est synthétique, nous contrôlons tous les aspects et générons rapidement des dizaines de milliers de paires d'image-matrice (quelque chose de presque impossible avec les configurations du monde réel). C'est une façon d'enseigner aux robots non seulement voir, mais pour comprendre l'espace comme un être physique. »

Jusqu'à présent, le cadre introduit par les chercheurs est simplement théorique, mais il pourrait bientôt ouvrir de nouvelles possibilités pour la formation de VLM réels. Les chercheurs eux-mêmes pourraient bientôt évaluer son potentiel en formant un modèle en utilisant l'ensemble de données qu'ils ont compilé ou des données générées par synthèse similaires.

« Ce que nous avons fait est fondamentalement conceptuel », a déclaré Currie. « Nous proposons une nouvelle façon pour l'IA d'apprendre l'espace, non seulement à partir de son propre point de vue, mais de quelqu'un d'autre. Au lieu d'une géométrie codée en dur, nous traitons la perspective visuelle comme quelque chose que le modèle peut apprendre en utilisant la vision et le langage. C'est une étape vers la cognition incarnée – les observations qui ne voient pas simplement le monde, mais peuvent imaginer à quoi cela ressemble aux autres. Nous voyons cela comme une fondation pour la véritable intelligence sociale dans les machines. »

Les travaux récents de De Tommaso, Currie, Migno et leurs collègues pourraient inspirer la génération d'autres ensembles de données synthétiques similaires pour la formation des VLM sur les tâches de raisonnement spatial. Ces efforts pourraient collectivement contribuer à l'amélioration des robots humanoïdes et d'autres agents d'IA incarnés, facilitant potentiellement leur déploiement dans des contextes réels.

« Notre prochaine étape sera de rendre l'environnement virtuel aussi réaliste que possible, rapprochant la distance entre une scène de l'espace simulé et du monde réel », a ajouté Gioele Migno, diplômé en intelligence artificielle et en robotique de l'Université Sapienza de Rome et a récemment rejoint l'unité de recherche S4HRI à l'IIT en tant que boursier.

« Cette étape est cruciale pour transférer les connaissances acquises par le modèle en simulation dans le monde réel, et pour permettre à un robot incarné d'exploiter le raisonnement spatial. Une fois que cela est atteint, nous sommes ensuite intéressés à étudier comment ces capacités peuvent rendre les interactions avec les humains plus efficaces dans les scénarios où ils partagent une compréhension spatiale de la scène. »

Écrit pour vous par notre auteur Ingrid Fadelli, édité par Lisa Lock, et vérifié et examiné par Robert Egan – cet article est le résultat d'un travail humain minutieux. Nous comptons sur des lecteurs comme vous pour garder le journalisme scientifique indépendant en vie. Si ce rapport vous importe, veuillez considérer un don (surtout mensuel). Vous obtiendrez un sans publicité compte comme un remerciement.