Un nouveau cadre augmente la transparence dans les systèmes de prise de décision

Une nouvelle technique d'IA explicable classe transparente les images sans compromettre la précision. La méthode, développée à l'Université du Michigan, ouvre l'IA pour des situations où comprendre pourquoi une décision a été prise est tout aussi importante que la décision elle-même, comme le diagnostic médical.

Si un modèle d'IA signale une tumeur comme maligne sans spécifier ce qui a incité le résultat – comme la taille, la forme ou une ombre dans l'image – les docteurs ne peuvent pas vérifier le résultat ou l'expliquer au patient. Pire, le modèle a peut-être repris sur les modèles trompeurs dans les données que les humains reconnaîtraient comme non pertinentes.

« Nous avons besoin de systèmes d'IA en qui nous pouvons avoir confiance, en particulier dans des domaines à enjeux élevés comme les soins de santé. Si nous ne comprenons pas comment un modèle prend des décisions, nous ne pouvons pas compter en toute sécurité sur elle. Je veux aider à construire une IA, non seulement un professeur adjoint, mais aussi de l'ingénierie industrielle et des opérations à l'interprétation de l'UM et de l'étude à la présentation de l'après-midi du 17 juillet au 17 juillet à la conférence internationale à la conférence internationale sur le VANCUS, à l'étude, à la présentation de l'après-midi de juillet 17 à la conférence internationale à la conférence internationale sur la conférence sur la conférence sur le VANCou, à l'étude, à la présentation de l'après-midi du 17 juillet au 17 juillet à la conférence internationale sur la conférence sur la conférence sur la conférence sur la machine dans le Vancou Columbia.

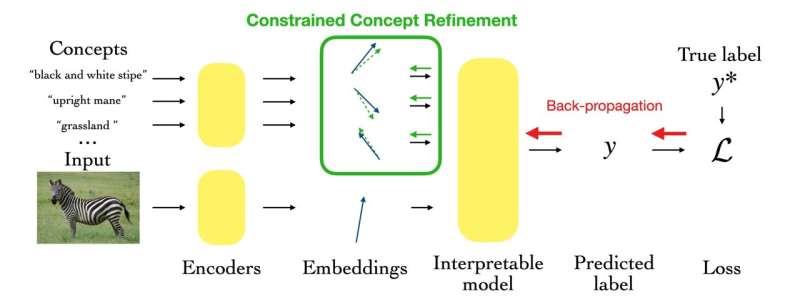

Lors de la classification d'une image, les modèles AI associent des vecteurs de nombres à des concepts spécifiques. Ces ensembles de nombres, appelés intégres concept, peuvent aider l'IA à localiser des choses comme la «fracture», «arthrite» ou «os sain» dans une radiographie. L'IA explicable s'efforce de rendre les intérêts du concept interprétables – ce qui signifie qu'une personne peut comprendre ce que les chiffres représentent et comment il influence les décisions du modèle.

Les méthodes AI explicables précédentes ajoutent des fonctionnalités d'interprétation après la construction du modèle. Bien que ces approches puissent identifier les facteurs clés qui ont influencé les prédictions des modèles, ils ne sont pas par contre-intuitifs eux-mêmes. Ces modèles traitent également les intérêts du concept comme des vecteurs numériques fixes, ignorant les erreurs potentielles ou les fausses déclarations inhérentes.

Par exemple, ces modèles intégrent le concept d ' »os sain » en utilisant un modèle multimodal pré-entraîné tel que CLIP. Contrairement aux ensembles de données soigneusement organisés, Clip est formé sur des paires de texte d'image bruyantes à grande échelle grattées d'Internet. Ces paires comprennent souvent des données mal étiquetées, des descriptions vagues ou des associations biologiquement incorrectes, entraînant des incohérences dans les intérêts qui en résultent.

Publié sur le arxiv Preprint Server, le nouveau framework – Concept Concept Concept Concept ou CCR – admette le premier problème en intégrant et en optimisant l'interprétabilité directement dans l'architecture du modèle. Il résout la seconde en introduisant la flexibilité dans les intégres du concept, leur permettant de s'adapter à la tâche spécifique à accomplir.

Les utilisateurs peuvent basculer le cadre pour favoriser l'interprétabilité, avec plus de restrictions d'intégration de concepts ou de précision en permettant aux intégres de concepts de s'égarer un peu plus. Cette flexibilité supplémentaire permet à l'incorporation de concept potentiellement inexacte de « os sain » – comme obtenu à partir de clip – pour être automatiquement ajusté et corrigé en s'adaptant aux données disponibles. En tirant parti de cette flexibilité supplémentaire, l'approche CCR peut améliorer à la fois l'interprétabilité et la précision du modèle.

« Ce qui m'a le plus surpris, c'est de réaliser que l'interprétabilité n'a pas à se faire au prix de l'exactitude. En fait, avec la bonne approche, il est possible de réaliser les deux – des décisions clandestibles et des performances solides – de manière simple et efficace », a déclaré Fattahi.

CCR a surpassé deux méthodes explicables (CLIP-IP-AMP et CBM sans étiquette) dans la précision de la prédiction tout en préservant l'interprétabilité lorsqu'il est testé sur trois repères de classification d'image (CIFAR10 / 100, Net d'image, places365). Surtout, la nouvelle méthode a décuplé le décuplé, offrant de meilleures performances avec des coûts de calcul inférieurs.

« Bien que nos expériences actuelles se concentrent sur la classification des images, le faible coût de mise en œuvre de la méthode et la facilité de réglage suggèrent un fort potentiel pour une applicabilité plus large dans divers domaines d'apprentissage automatique », a déclaré Geyu Liang, diplômé de doctorat en génie industriel et opérationnel chez UM et auteur principal de l'étude.

Par exemple, l'IA est de plus en plus intégrée à l'OMS qui se qualifie pour les prêts, mais sans explicabilité, les candidats sont laissés dans l'obscurité lorsqu'ils sont rejetés. L'IA explicable peut accroître la transparence et l'équité de la finance, garantissant qu'une décision était basée sur des facteurs spécifiques tels que les revenus ou les antécédents de crédit plutôt que sur des informations biaisées ou non liées.

« Nous n'avons fait que gratter la surface. Ce qui m'excite le plus, c'est que notre travail offre des preuves solides que l'explication peut être introduite dans l'IA moderne d'une manière étonnamment efficace et à faible coût », a déclaré Fattahi.