Nous ne savons pas si votre histoire est la vôtre, d'Openai ou du gouvernement

Tout ce que vous écrivez peut être utilisé contre vous. C'est ce que la justice des États-Unis soulève lorsque vous essayez de forcer Openai à indéfinir tous les enregistrements de nos conversations avec Chatgpt. Non seulement cela: ils exigent également de garder les conversations que nous croyions théoriquement avoir éliminées. La situation rend la question inévitable: donc toutes ces données, à qui appartient?

Le New York Times vs Openai est compliqué. Toute la situation actuelle découle du processus juridique qui fait face au prestigieux journal avec la société d'intelligence artificielle. Cette confrontation fonctionne depuis 17 mois. L'argument initial de NYT était qu'Openai avait formé ses modèles avec le contenu du NYT qu'il a également montré dans ses réponses aux utilisateurs. Maintenant, la chose va plus loin.

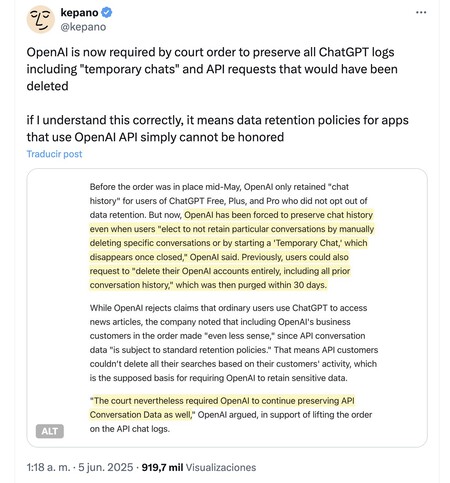

Ne pensez même pas aux chats. Après une récente demande de NYT, le juge Ona Wang qui prend le cas ordonné à OpenAI pour lancer la préservation indéfinie des enregistrements de tous les contenus potentiellement pertinents, y compris les chats temporaires et même la sortie du texte générée par l'API et qui utilisent les utilisateurs de paiement. Jusqu'à ce moment, la politique de rétention des données OpenAI a imposé une limite de 30 jours pour préserver les conversations. Ensuite, théoriquement, ils ont été effacés sans plus.

Murs de paiement. La peur de NYT et d'autres moyens sont que les utilisateurs utilisent Chatgpt pour sauter les murs de paiement « pourraient être plus enclins à effacer toutes leurs recherches pour couvrir leurs empreintes », a expliqué Openai dans le processus judiciaire. Selon les plaignants, des preuves qui démontrent qu'il manque parce qu'OpenAI n'a que des échantillons d'OCMPartido d'enregistrements de discussion que les utilisateurs avaient accepté que l'entreprise conservait.

Openai Appels. La réponse officielle d'Openai aux demandes de données du NYT est claire: « Nous croyons fermement qu'il s'agit d'une dépassement. Cela met en danger votre vie privée sans vraiment contribuer à résoudre la demande. C'est pourquoi nous nous opposons. » Les responsables de l'entreprise expliquent qu'ils ont demandé au juge de reconsidérer l'ordonnance soulignant que « cette rétention indéfinie des données des utilisateurs viole les normes de l'industrie et nos propres politiques ».

Quelles données sont affectées par la commande. La demande du juge est très large, mais il y a des détails importants qui permettent de clarifier qui n'est pas là:

- Si vous utilisez la version gratuite ChatGPT, si vous utilisez un abonnement pour ChatGpt Plus, Pro ou Team ou si vous utilisez l'API OpenAI sans accord ZDR (rétention de données zéro), vous êtes affecté et vos chats pourraient être préservés indéfiniment.

- Les comptes ChatGpt Enterprise ou ChatGpt Edu ne sont pas affectés par cette commande.

- Les utilisateurs d'API qui ont opté pour ZDR ne sont pas affectés par l'accord.

Qu'est-ce que ZDR. La « modification ZDR » fait référence à la politique de non-rétention des données (rétention de données zéro) qui garantit que les invites ne sont pas enregistrées, et les modèles ne s'entraînent pas avec nos données. Cette gestion des données est particulièrement importante pour les utilisations commerciales, donc dans Chatgpt Enterprise, elle est activée par défaut. Pour le reste des plans, ZDR n'est pas activé par défaut et les entreprises et les personnes intéressées doivent contacter OpenAI pour négocier les conditions. Il n'y a pas de prix publiés pour cette option, mais c'est un service supplémentaire et, en tant que tel, impose un coût supplémentaire dans l'utilisation de l'API des modèles OpenAI.

Sans preuve. Selon OpenAI, rien ne prouve qu'ils aient invité les données intentionnellement et que tout est de la spéculation. De plus, il n'y a pas non plus de preuve que les utilisateurs qui violent le droit d'auteur lors de l'utilisation de ChatGpt pour éviter les murs de paiement sont plus susceptibles d'effacer leurs conversations. « OpenAI n'a pas détruit de données et n'a bien sûr pas supprimé les données en réponse aux événements du différend. L'ordonnance (judiciaire) semble avoir supposé incorrectement autrement. »

Données sensibles. La société défend son devoir de protéger « les données et la confidentialité de ses utilisateurs » et explique que des millions d'utilisateurs utilisent quotidiennement Chatgpt pour des raisons qui vont « du banal au profondément personnel ». Cela fait que ces utilisateurs partagent des données sensibles qui affectent non seulement les informations financières ou médicales, mais aussi leurs sentiments et leurs réflexions privées.

Ramifications. L'impact de cette ordonnance du tribunal est potentiellement énorme. En tant qu'utilisateur appelé Kepano l'a indiqué dans X, « Si je l'ai compris correctement, cela signifie que les politiques de conservation des données des applications qui utilisent l'API OpenAI ne peuvent tout simplement pas être réalisées. » Autrement dit, si une troisième entreprise qui utilise des modèles OpenAI pour fournir son service promet que vos données seront maintenues privées ne pourront pas garantir cette promesse. Les implications pour les utilisateurs de toutes sortes sont claires. Dans ARS Technica, ils ont cité le commentaire d'un utilisateur de LinkedIn a suggéré que cette ordonnance du tribunal ait créé « une rupture grave de contrat pour toutes les sociétés qui utilisent OpenAI ». et a également mis en évidence des messages dans X des utilisateurs qui ont affirmé que « chacun des services de l'IA » motivé par « Openai devrait s'inquiéter » de cette situation.

Qui appartient aux données? Cette ordonnance du tribunal ouvre un débat inquiétant: qui a le contrôle des données que nous échangeons avec Chatgpt et, par extension, avec tout autre chatbot. Ces entreprises sont théoriquement responsables de la gestion de ces données et des éliminations, mais sont-elles la vôtre?

- Chatgpt et Gemini utilisent des chats pour former leurs modèles par défaut, bien que ce comportement puisse être désactivé. Ni Claude ni Co -ilot ne le font, par exemple. Les données dans ces deux derniers cas sont quelque chose de «plus à vous».

- Mais ils continuent de les garder pendant une période variable qui est généralement de 30 jours

- Avec cette ordonnance du tribunal, les États-Unis se disent pour pouvoir accéder à ces données si vous en avez besoin, bien qu'il doit y avoir une enquête judiciaire en tant que celle qui est effectuée avec le New York Times.

- Et pourtant, ces données sont encore plus précieuses en tant que source d'informations non seulement pour les entreprises privées, mais pour les agences et services de renseignement. Et nous savons déjà comment la NSA dépense.

Comment ils agissent normalement. Les politiques de rétention des données sont similaires dans tous les cas et suppriment toutes ces entrées et sorties (chats) après 30 jours. Ces sociétés ont également généralement des options pour cette non-rétention de données – anthropic l'a également – qui peut être appliquée par exemple aux utilisations commerciales ou privées. Cependant, les doutes sur qui à la fin a ce contrôle sur les données est clair, et cet essai ne fait que les a augmentés.

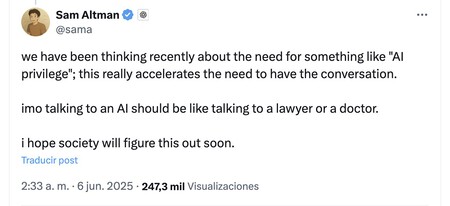

Chatbots et confidentialité. Compte tenu de l'utilisation de plus en plus sensible de ces chatbots – professionnel en tant que personnel – il devrait y avoir des garanties beaucoup plus fortes que Chatgpt, Gemini, Claude et d'autres chatbots sur le marché traitent ces conversations de manière absolument confidentielle. C'est exactement ce que Sam Altman a élevé il y a quelques heures en disant que « parler avec une IA devrait être comme parler à un avocat ou à un médecin ».

Et le chiffrement, quoi? Une option serait que ces conversations avec ces chatbots pourraient être cryptées de bout en bout, comme avec les services de messagerie instantanés, mais dans la pratique, c'est impossible. Les serveurs qui collectent notre demande doivent «le voir» pour le traiter et retourner une réponse, et le cryptage rendrait cela impossible. Apple a déjà soulevé une solution avec un calcul de cloud privé, mais pour l'instant les principales sociétés de l'IA conservent une approche dans laquelle ces conversations sont traitées sans cryptage. La garantie de confidentialité est ce qu'ils disent avec leurs utilisateurs, mais bien sûr, ils ont accès à ces conversations s'ils en ont besoin.

Image | Kaitlyn Baker

Dans Simseo | Vous avez pensé à naviguer dans des cookies inconnus et effaçait votre mobile Android. Objectif j'ai vu tout ce que tu as fait