Mode AI, PROJET POUR, I VOIR 3, L'AURA PROJET, JULES GLASSES et tout ce qui est présenté dans une I / ou 2025 Google chargée d'ambition

Google a pris l'artillerie lourde de la guerre pour diriger le développement – et l'entreprise – de la intelligence artificielle. Le géant américain l'a fait lors de sa conférence annuelle pour les développeurs, que plus que cela a été une démonstration de force, une vitrine où il a présenté certaines de ses avancées les plus innovantes.

Ensuite, nous passons en revue toutes les nouvelles que Google a présentées ce mardi 20 mai. Dans chacun d'eux, vous trouverez des liens qui vous permettront d'élargir les informations.

Gemini Ultra, je vois 3 et Image 4: un abonnement à ceux qui veulent tout

- Gemini Ultra est le nouvel abonnement à l'intelligence artificielle la plus complète de Google. Il en coûte 249,99 $ par mois et, pour l'instant, il n'est disponible qu'aux États-Unis.

- Comprend l'accès à des outils tels que le générateur de vidéos que je vois 3, l'application d'édition de flux et le mode de réflexion Deep de Gemini 2.5 Pro, qui n'a pas encore été officiellement publié.

- Les abonnés obtiennent également des améliorations dans Notebooklm et Wwisk, stockage de 30 To dans le cloud, YouTube Premium et accès au chatbot Gemini directement de Chrome.

- Certaines des fonctions les plus avancées sont motivées par la technologie de Project Mariner, qui donne aux agents des capacités « agricoles ».

Pensée profonde: une IA qui prend du temps pour mieux répondre

- Deep Think est un nouveau mode de raisonnement du modèle Gemini 2.5 Pro qui permet à l'IA de considérer plusieurs réponses possibles avant de décider d'un.

- Il cherche à améliorer la précision dans les tâches complexes et les repères avancés.

Il n'est actuellement disponible que pour un petit groupe de test via l'API de Gemini. - Google déclare qu'il effectue des évaluations de la sécurité avant de le lancer publiquement.

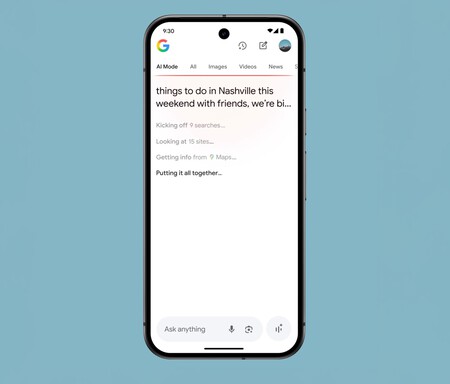

Mode AI et recherche en direct: de cette façon, Google veut repenser la recherche

- Le mode AI est une nouvelle fonction expérimentale pour la recherche de Google qui vous permet de poser des questions complexes, avec plusieurs éléments, à partir d'une interface basée sur l'IA.

- Il est lancé cette semaine aux États-Unis et est en mesure de gérer les sports, les données financières et les options telles que le virtuel «testé».

- Tout au long de la recherche d'été en direct arrivera, une fonction qui permettra de poser des questions en fonction de ce que la caméra mobile détecte en temps réel.

Gémeaux dans le chrome et détection du contenu synthétique

- Gemini est intégré dans Chrome en tant qu'assistant de navigation pour aider à comprendre le contenu des pages Web et à exécuter des tâches.

- Gmail intègre des réponses intelligentes personnalisées et une nouvelle fonction pour nettoyer la boîte de réception.

- Google a lancé Synthed Detector, un système de vérification qui utilise des marques d'eau invisibles pour identifier le contenu généré par l'IA.

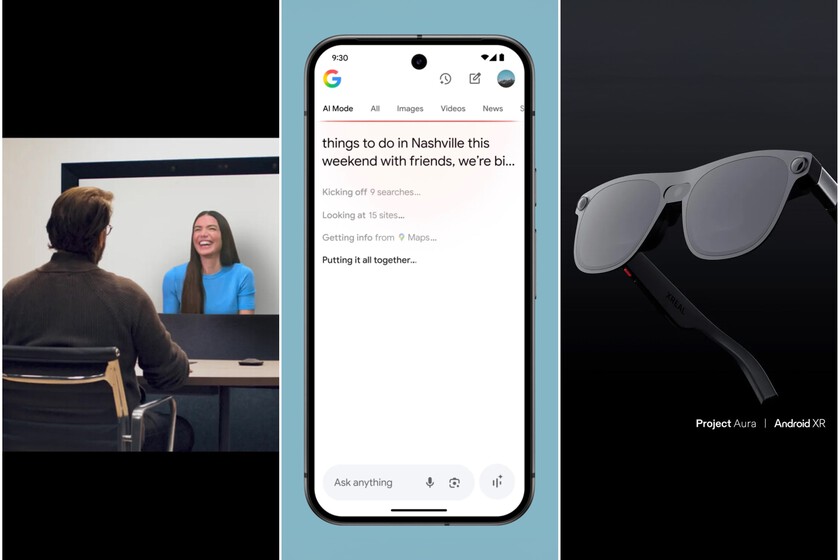

Poutre: appel vidéo 3D avec traduction simultanée

- Beam, anciennement connu sous le nom de Project Starline, convertit les appels vidéo en conversations presque face à face grâce à une matrice à six caméras et à un écran de terrain léger.

- Il offre le siège du millimètre et de la vidéo à 60 images par seconde.

- Il comprend une traduction en temps réel dans Google Meet, préservant la voix, le ton et les expressions du haut-parleur d'origine.

Jules: Google Agent à programmer sans toucher le clavier

- Jules est le nouvel agent de programmation assisté de Google, conçu pour rivaliser avec des plates-formes telles que le curseur, la planche à voile ou le codex.

- Il est capable de générer des tests, de mettre à jour les dépendances, d'écrire des modifications en audio et de corriger les bogues tandis que l'utilisateur continue de travailler sur d'autres choses.

- Il fonctionne sans plugins ni installations supplémentaires et est disponible en bêta publique pour les utilisateurs américains.

Android également présent à l'événement

- Android présente de nouveaux outils pour trouver des téléphones et des objets perdus, ainsi qu'un nouveau langage de conception appelé Material 3 Expressif.

- Google a montré ses nouvelles lunettes en direct, développées avec Xreal et basée sur Android XR.

- La démo comprenait l'interaction avec les Gémeaux par voix, la traduction simultanée et le chevauchement des informations réelles.

- Le projet s'appelle Project Aura et cherche à amener Android au monde XR avec un et des ornements pratiques.

Images | Google

Dans Simseo | Les lunettes intelligentes ne doivent pas être armées. Google a plus clair que jamais