Quand la mobilité autonome apprend à se demander

La mobilité autonome existe déjà, dans une certaine mesure. Construire un véhicule autonome qui peut naviguer en toute sécurité sur une autoroute vide est une chose. Le vrai défi réside dans l’adaptation à la réalité dynamique et désordonnée des environnements urbains.

Contrairement aux rues en forme de grille de nombreuses villes américaines, les routes européennes sont souvent étroites, sinueuses et irrégulières. Les environnements urbains ont d’innombrables intersections sans marques claires, zones piétonnes, ronds-points et zones où les vélos et les scooters partagent la route avec les voitures. La conception d’un système de mobilité autonome qui peut fonctionner en toute sécurité dans ces conditions nécessite plus que des capteurs et des caméras sophistiqués.

Il s’agit principalement de relever un énorme défi: prédire la dynamique du monde, en d’autres termes, comprendre comment les humains naviguent dans des environnements urbains donnés. Les piétons, par exemple, prennent souvent des décisions spontanées telles que la traversée dans une rue, changeant soudainement de direction ou tissant à travers la foule. Un enfant pourrait courir après un chien. Les cyclistes et les scooters compliquent encore l’équation, avec leurs manœuvres agiles et souvent imprévisibles.

« La mobilité autonome, que ce soit sous la forme de voitures autonomes ou de robots de livraison, doit évoluer au-delà de la simple réaction au moment présent. Pour naviguer dans notre monde complexe et dynamique, ces systèmes axés sur l’IA ont besoin de la capacité d’imaginer, d’anticiper et de simuler des futurs possibles – tout comme les humains le font lorsque nous nous demandons ce qui pourrait arriver ensuite. Dans l’essence, Ai doit apprendre à se demander Alexandre Alahi, le chef de la faculté d’Epf (Vita).

Pousser les limites de la prédiction: GEM

Au Vita Laboratory, l’objectif de faire de l’IA « Wonder » devient une réalité. Cette année, l’équipe a eu sept articles acceptés à la conférence sur la vision par ordinateur et la reconnaissance des modèles (CVPR’25) qui se tiendra à Nashville, du 11 au 15 juin. Chaque contribution introduit une nouvelle méthode pour aider les systèmes AI à imaginer, prédire et simuler des futurs possibles – de la prévision du mouvement humain à la génération de séquences vidéo entières.

Dans l’esprit de la science ouverte, tous les modèles et ensembles de données sont publiés sous forme d’open source, ce qui permet à la communauté de la recherche mondiale et à l’industrie de s’appuyer sur et d’étendre ce travail. Ensemble, ces contributions représentent un effort unifié pour donner à la mobilité autonome la capacité non seulement à réagir, mais à vraiment anticiper le monde qui les entoure.

L’un des modèles les plus innovants est conçu pour prédire les séquences vidéo d’une seule image capturée par une caméra montée sur un véhicule (ou toute vue égocentrique). Appelée GEM (modèle multimodal mondial de la vision généralisable), il aide les systèmes autonomes à anticiper les événements futurs en apprenant comment les scènes évoluent au fil du temps.

Dans le cadre de l’initiative Swiss IA, et en collaboration avec quatre autres institutions (Université de Berne, SDSC, Université de Zurich et Eth Zurich), ils ont formé leur modèle en utilisant 4000 heures de vidéos couvrant la conduite autonome, des activités humaines égocentriques (signification, activités du point de vue de la première personne) et des séquences de drones.

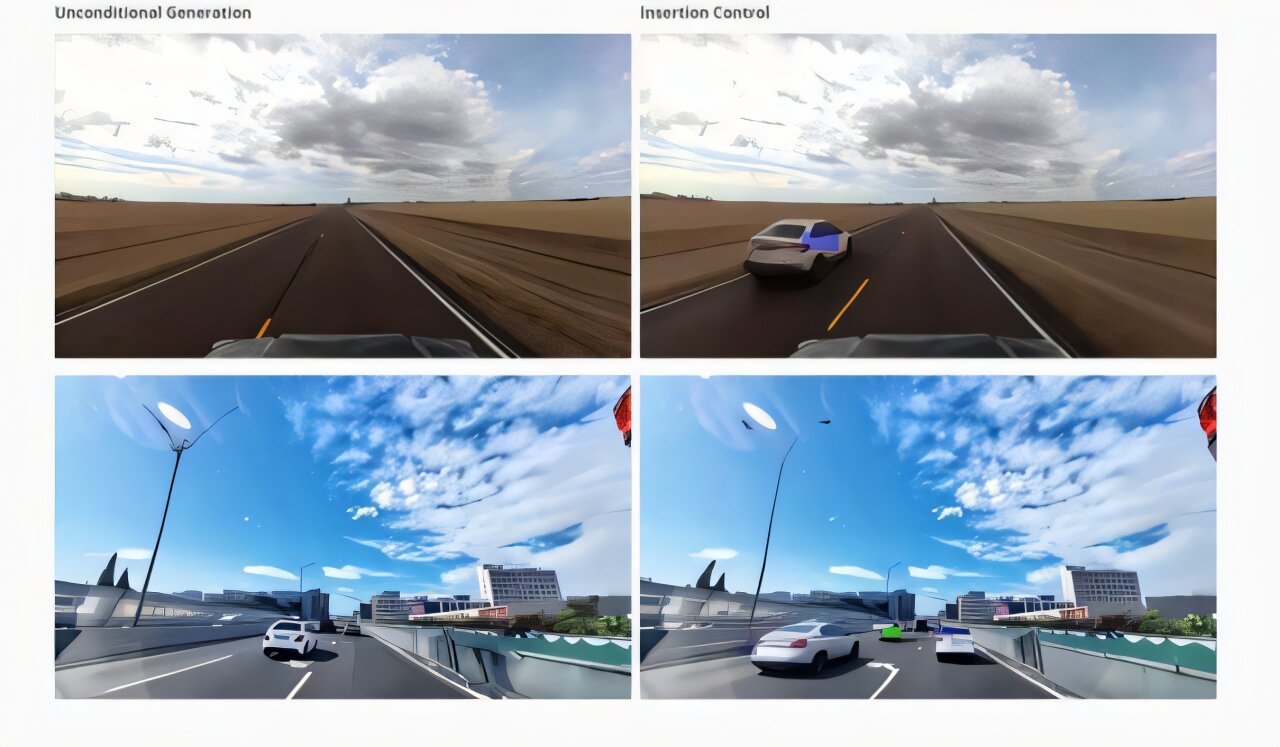

GEM apprend comment les gens et les objets se déplacent dans différents environnements. Il utilise ces connaissances pour générer des séquences vidéo entièrement nouvelles qui imaginent ce qui pourrait arriver ensuite dans une scène donnée, qu’il s’agisse d’un piéton traversant la rue ou d’une voiture tournant à une intersection.

Ces scénarios imaginés peuvent même être contrôlés en ajoutant des voitures et des piétons, ce qui fait de GEM un outil puissant pour entraîner et tester en toute sécurité les systèmes autonomes dans un large éventail de situations réalistes.

Pour faire ces prédictions, le modèle examine simultanément plusieurs types d’informations, également appelés modalités. Il analyse les images RVB – qui sont des cadres vidéo en couleur standard – pour comprendre le contexte visuel d’une scène et des cartes de profondeur pour saisir sa structure 3D. Ces deux types de données permettent au modèle d’interpréter à la fois ce qui se passe et où les choses se trouvent dans l’espace.

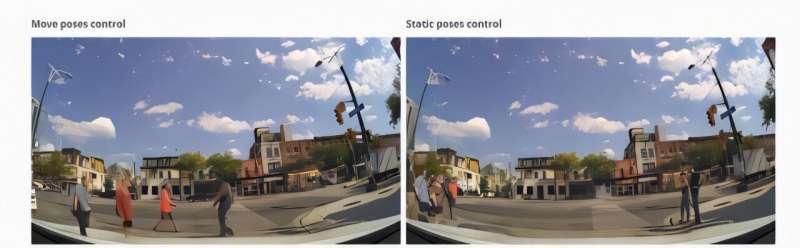

GEM prend également en compte le mouvement de la caméra (mouvement de l’ego), les poses humaines et la dynamique des objets au fil du temps. En apprenant comment tous ces signaux évoluent ensemble sur des milliers de situations du monde réel, il peut générer des séquences cohérentes et réalistes qui reflètent comment une scène pourrait changer dans les prochaines secondes.

« L’outil peut fonctionner comme un simulateur réaliste pour les véhicules, les drones et autres robots, permettant le test sûr des politiques de contrôle dans des environnements virtuels avant de les déployer dans des conditions réelles. Il peut également aider à planifier en aidant ces robots à anticiper les changements dans leur environnement, ce qui rend la prise de décision plus robuste et contextuelle », a déclaré Mariam Hassan, Ph.D étudiant à Vita Lab.

La route des prédictions

La prédiction du comportement humain est un défi complexe et multiples, et GEM ne représente qu’un seul morceau de l’effort plus large du Vita Lab pour y faire face. Alors que GEM se concentre sur la génération des vidéos de l’avenir et l’exposition des systèmes autonomes à divers scénarios virtuels, d’autres projets de recherche de l’équipe du professeur Alahi abordent des niveaux d’abstractions inférieurs pour améliorer la prédiction avec la robustesse, la généralisation et la conscience sociale.

Par exemple, l’un d’eux vise à certifier où les gens se déplaceront, même lorsque les données sont incomplètes ou légèrement désactivées. Pendant ce temps, MotionMap aborde l’imprévisibilité inhérente du mouvement humain à travers une approche probabiliste. Cette approche probabiliste aide les systèmes à se préparer à des mouvements inattendus dans des environnements dynamiques.

Ces efforts constituent un cadre complet qui trace les interactions complexes en jeu dans des environnements urbains bondés. Il y a encore des défis: la cohérence à long terme, la précision spatiale à haute fidélité et l’efficacité de calcul sont toujours en évolution. Au cœur de tout cela réside la question la plus difficile: comment prédions-nous les personnes qui ne suivent pas toujours les modèles? Les décisions humaines sont façonnées par l’intention, l’émotion et le contexte – des facteurs qui ne sont pas toujours visibles pour les machines.