L’IA sur la confiance excessive reflète un trouble du langage humain

Les agents, les chatbots et autres outils basés sur l’intelligence artificielle (IA) sont de plus en plus utilisés dans la vie quotidienne par beaucoup. Les agents basés sur les modèles dits de grande langue (LLM), tels que Chatgpt et Llama, sont devenus de manière impressionnante dans les réponses qu’ils forment, mais fournissent souvent des informations convaincantes mais incorrectes.

Les chercheurs de l’Université de Tokyo établissent des parallèles entre cette question et un trouble du langage humain connu sous le nom d’aphasie, où les victimes peuvent parler couramment mais faire des déclarations dénuées de sens ou difficiles à comprendre. Cette similitude pourrait pointer vers de meilleures formes de diagnostic pour l’aphasie, et même fournir un aperçu des ingénieurs d’IA cherchant à améliorer les agents basés sur la LLM.

Cet article a été écrit par un être humain, mais l’utilisation de l’IA générateurs de texte est en augmentation dans de nombreux domaines. Alors que de plus en plus de gens s’utilisent et comptent sur de telles choses, il y a un besoin toujours croissant de s’assurer que ces outils offrent des réponses et des informations correctes et cohérentes à leurs utilisateurs.

De nombreux outils familiers, y compris Chatgpt et autres, semblent très courants dans tout ce qu’ils livrent. Mais leurs réponses ne peuvent pas toujours être invoquées en raison de la quantité de contenu essentiellement inventé qu’ils produisent. Si l’utilisateur n’est pas suffisamment bien informé sur le domaine en question, il peut facilement tomber en vue de supposer que ces informations sont correctes, en particulier étant donné le degré élevé de confiance que Chatgpt et d’autres montrent.

« Vous ne pouvez pas manquer de remarquer comment certains systèmes d’IA peuvent apparaître articulés tout en produisant des erreurs souvent importantes », a déclaré le professeur Takamitsu Watanabe du Centre international de recherche pour la neurointigence (WPI-IRCN) à l’Université de Tokyo.

« Mais ce qui a frappé mon équipe et moi, c’est une similitude entre ce comportement et celle des personnes atteintes de l’aphasie de Wernicke, où ces personnes parlent couramment mais n’ont pas toujours beaucoup de sens. Cela nous a incité à nous demander si les mécanismes internes de ces systèmes d’IA pourraient être similaires à ceux du cerveau humain affectés par l’aphasie, et si c’est le cas, ce que les implications pourraient être. »

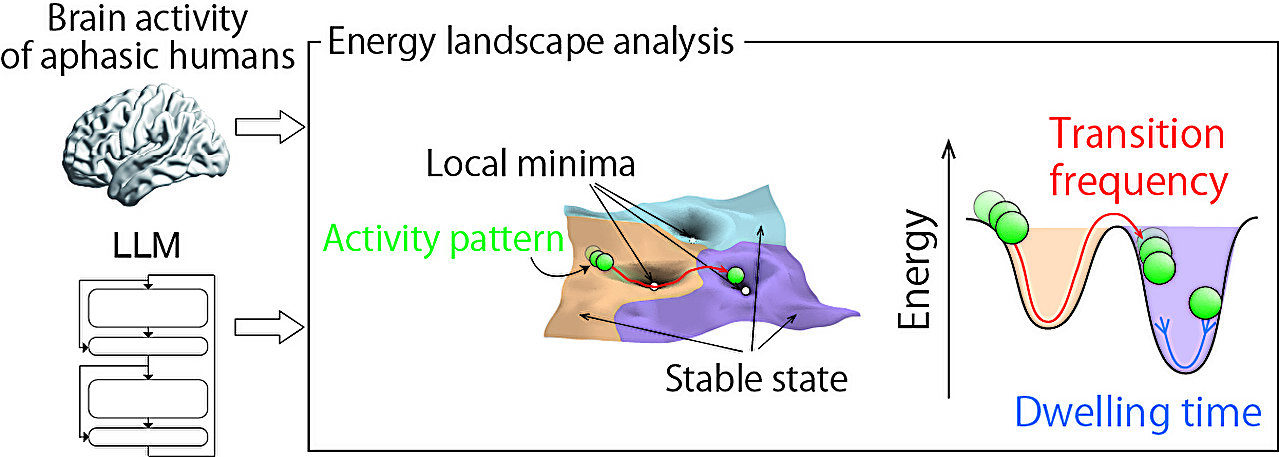

Pour explorer cette idée, l’équipe a utilisé une méthode appelée Energy Landscape Analysis, une technique développée à l’origine par des physiciens cherchant à visualiser les états d’énergie dans le métal magnétique, mais qui a été récemment adapté aux neurosciences. Le document est publié dans la revue Science avancée.

Ils ont examiné les modèles de l’activité cérébrale au repos de personnes atteintes de différents types d’aphasie et les ont comparées aux données internes de plusieurs LLM accessibles au public. Et dans leur analyse, l’équipe a découvert des similitudes frappantes.

La façon dont les informations numériques ou les signaux sont déplacées et manipulées dans ces modèles d’IA correspondaient étroitement à la façon dont certains signaux cérébraux se sont comportés dans le cerveau des personnes avec certains types d’aphasie, y compris l’aphasie de Wernicke.

« Vous pouvez imaginer le paysage énergétique comme une surface avec une balle dessus. Lorsqu’il y a une courbe, la balle peut se rouler et se reposer, mais lorsque les courbes sont peu profondes, le ballon peut rouler autour de chaotique », a déclaré Watanabe.

« En aphasie, la balle représente l’état cérébral de la personne. Dans les LLM, il représente le modèle de signal continu dans le modèle en fonction de ses instructions et de son ensemble de données interne. »

La recherche a plusieurs implications. Pour les neurosciences, il offre une nouvelle façon possible de classer et de surveiller les conditions comme l’aphasie basée sur l’activité du cerveau interne plutôt que sur des symptômes externes. Pour l’IA, cela pourrait conduire à de meilleurs outils de diagnostic qui aident les ingénieurs à améliorer l’architecture des systèmes d’IA de l’intérieur. Bien que, malgré les similitudes que les chercheurs ont découvertes, ils exhortent la prudence à ne pas faire trop d’hypothèses.

« Nous ne disons pas que les chatbots ont des lésions cérébrales », a déclaré Watanabe.

« Mais ils peuvent être enfermés dans une sorte de modèle interne rigide qui limite la façon dont ils peuvent s’appuyer avec flexion sur les connaissances stockées, tout comme dans l’aphasie réceptive. Que les futurs modèles puissent surmonter cette limitation reste à voir, mais la compréhension de ces parallèles internes peut également être la première étape vers une IA plus intelligente et plus fiable. »