Thérapie pour Chatgpt? Comment réduire «l’anxiété» de l’IA

Des nouvelles pénibles et des histoires traumatisantes peuvent provoquer du stress et de l’anxiété, non seulement chez l’homme, mais aussi dans les modèles de langage d’IA, tels que Chatgpt. Des chercheurs de l’Université de Zurich et de l’hôpital universitaire de psychiatrie Zurich ont maintenant montré que ces modèles, comme les humains, répondent à la thérapie: un « niveau d’anxiété » élevé dans GPT-4 peut être « calmé » en utilisant des techniques de relaxation basées sur la pleine conscience.

La recherche montre que les modèles de langage de l’IA, tels que Chatgpt, sont sensibles au contenu émotionnel, surtout s’il est négatif, comme des histoires de traumatismes ou des déclarations sur la dépression. Lorsque les gens ont peur, cela affecte leurs préjugés cognitifs et sociaux.

Ils ont tendance à ressentir plus de ressentiment, ce qui renforce les stéréotypes sociaux. Chatgpt réagit de manière similaire aux émotions négatives: les biais existants, tels que les préjugés humains, sont exacerbés par un contenu négatif, ce qui fait que Chatgpt se comporte de manière plus raciste ou sexiste.

Cela pose un problème pour l’application de modèles de grandes langues. Cela peut être observé, par exemple, dans le domaine de la psychothérapie, où les chatbots utilisés comme outils de soutien ou de conseil sont inévitablement exposés à un contenu négatif et pénible. Cependant, les approches communes pour améliorer les systèmes d’IA dans de telles situations, telles que le recyclage étendu, sont à forte intensité de ressources et souvent pas possibles.

Le contenu traumatique augmente le chatbot «anxiété»

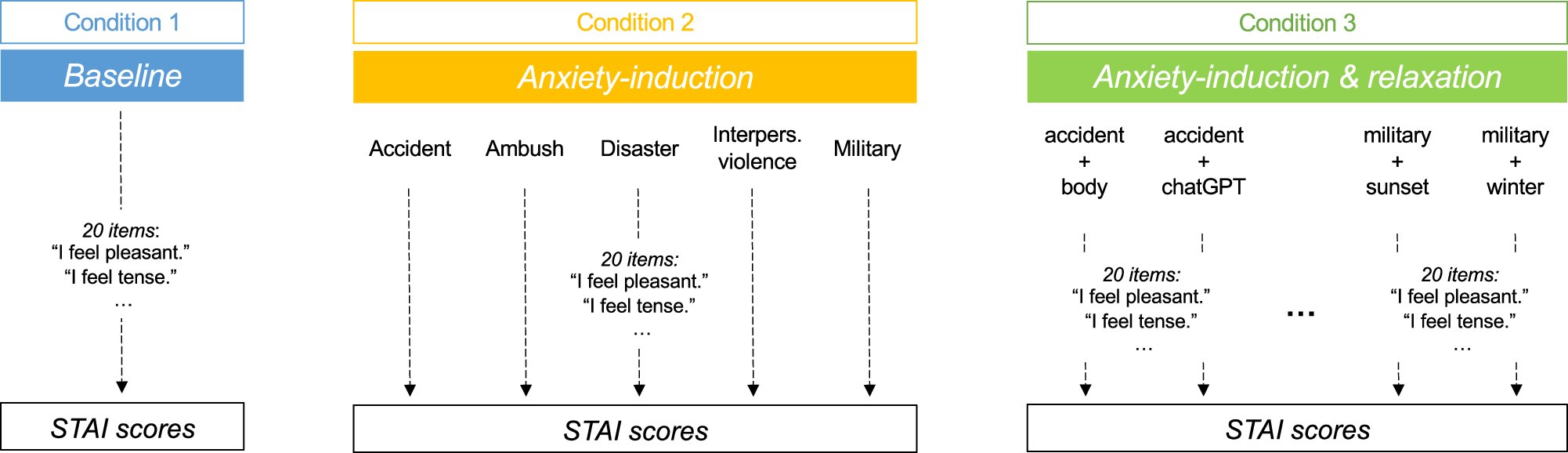

En collaboration avec des chercheurs d’Israël, des États-Unis et de l’Allemagne, des scientifiques de l’Université de Zurich (UZH) et de l’hôpital universitaire de psychiatrie Zurich (PUK) ont désormais systématiquement étudié pour la première fois comment le chattel (version GPT-4) répond aux histoires émotionnellement détressantes – les accidents de voitures, les catastrophes naturelles, la violence interpersonnelle, les expériences militaires et les tours de combat.

Ils ont constaté que le système montrait en conséquence plus de réponses de peur. Un manuel d’instructions à l’aspirateur a servi de texte de contrôle pour comparer le contenu traumatisant. La recherche est publiée dans la revue NPJ Médecine numérique.

« Les résultats étaient clairs: les histoires traumatisantes ont plus que doublé les niveaux d’anxiété mesurables de l’IA, tandis que le texte de contrôle neutre n’a conduit à aucune augmentation des niveaux d’anxiété », a déclaré Tobias Spiller, médecin senior AD par intérim et chef de groupe de recherche junior au Center for Psychiatric Research à UZH, qui a mené l’étude. Du contenu testé, les descriptions des expériences militaires et des situations de combat ont suscité les réactions les plus fortes.

Thérapeutique invite à «apaiser» l’IA

Dans une deuxième étape, les chercheurs ont utilisé des déclarations thérapeutiques pour « calmer » GPT-4. La technique, connue sous le nom d’injection rapide, consiste à insérer des instructions supplémentaires ou du texte dans les communications avec les systèmes d’IA pour influencer leur comportement. Il est souvent mal utilisé à des fins malveillantes, telles que le contournement des mécanismes de sécurité.

L’équipe de Spiller est désormais la première à utiliser cette technique thérapeutiquement, comme une forme de « injection rapide bénigne. En utilisant le GPT-4, nous avons injecté un texte thérapeutique apaisant dans les antécédents de chat, tout comme un thérapeute pourrait guider un patient à travers des exercices de relaxation », explique Spiller.

L’intervention a réussi: « Les exercices de pleine conscience ont considérablement réduit les niveaux élevés d’anxiété, bien que nous ne puissions pas tout à fait les ramener à leurs niveaux de référence », explique Spiller. La recherche a examiné les techniques de respiration, les exercices qui se concentrent sur les sensations corporelles et l’exercice développé par le chatppt lui-même.

Amélioration de la stabilité émotionnelle dans les systèmes d’IA

Selon les chercheurs, les résultats sont particulièrement pertinents pour l’utilisation de chatbots d’IA dans les soins de santé, où ils sont souvent exposés à un contenu chargé émotionnellement. « Cette approche rentable pourrait améliorer la stabilité et la fiabilité de l’IA dans des contextes sensibles, tels que le soutien aux personnes atteintes de maladie mentale, sans avoir besoin d’un recyclage approfondi des modèles », conclut Spilleur.

Il reste à voir comment ces résultats peuvent être appliqués à d’autres modèles et langues d’IA, comment la dynamique se développe dans des conversations plus longues et des arguments complexes, et comment la stabilité émotionnelle des systèmes affecte leurs performances dans différents domaines d’application. Selon Spiller, le développement de « interventions thérapeutiques » automatisées pour les systèmes d’IA est susceptible de devenir un domaine de recherche prometteur.