Les tâches basées sur la psychologie évaluent les limites de cognition visuelle LLM multimodale

Au cours des dernières décennies, les informaticiens ont créé des modèles d’intelligence artificielle de plus en plus avancés (IA), dont certains peuvent fonctionner de manière similaire aux humains sur des tâches spécifiques. La mesure dans laquelle ces modèles «pensent» et analysent vraiment des informations comme les humains, cependant, est toujours un sujet de discussion animé.

Des chercheurs du Max Planck Institute for Biological Cybernetics, de l’Institut d’IA centré sur l’homme à Helmholtz Munich et de l’Université de Tubingen ont récemment décidé de mieux comprendre la mesure dans laquelle Modèles, saisissez les interactions complexes et les relations dans les tâches de cognition visuelle.

Leurs résultats, publiés dans Intelligence de la machine de la natureMontrez que, même si certains LLM fonctionnent bien dans les tâches qui impliquent le traitement et l’interprétation des données, elles ne parviennent souvent pas à dériver des subtilités que les humains saisissaient.

« Nous avons été inspirés par un article influent de Brenden M. Lake et d’autres, ce qui a décrit les principaux composants cognitifs nécessaires pour que les modèles d’apprentissage automatique soient considérés comme humains », Luca M. Schulze Buschoff et Elif Akata, co-auteurs du journal, dit à Tech Xplore.

« Lorsque nous avons commencé notre projet, il y avait des progrès prometteurs dans les modèles de langage de vision qui peuvent traiter à la fois la langue et les images. Cependant, de nombreuses questions sont restées quant à savoir si ces modèles pouvaient effectuer un raisonnement visuel de type humain. »

L’objectif principal de la récente étude de Buschoff, Akata et leurs collègues était d’évaluer la capacité des LLM multimodaux à saisir des aspects spécifiques des tâches de traitement visuel, telles que la physique intuitive, les relations occasionnelles et la compréhension intuitive des préférences des gens. Cela pourrait à son tour aider à faire la lumière sur la mesure dans laquelle les capacités de ces modèles pourraient en fait être considérées comme des humains.

Pour déterminer cela, les chercheurs ont réalisé une série d’expériences contrôlées, où ils ont testé les modèles sur des tâches dérivées des études de psychologie passées. Cette approche des tests de l’IA a été lancée pour la première fois dans un article antérieur de Marcel Binz et Eric Schulz, publié dans PNA.

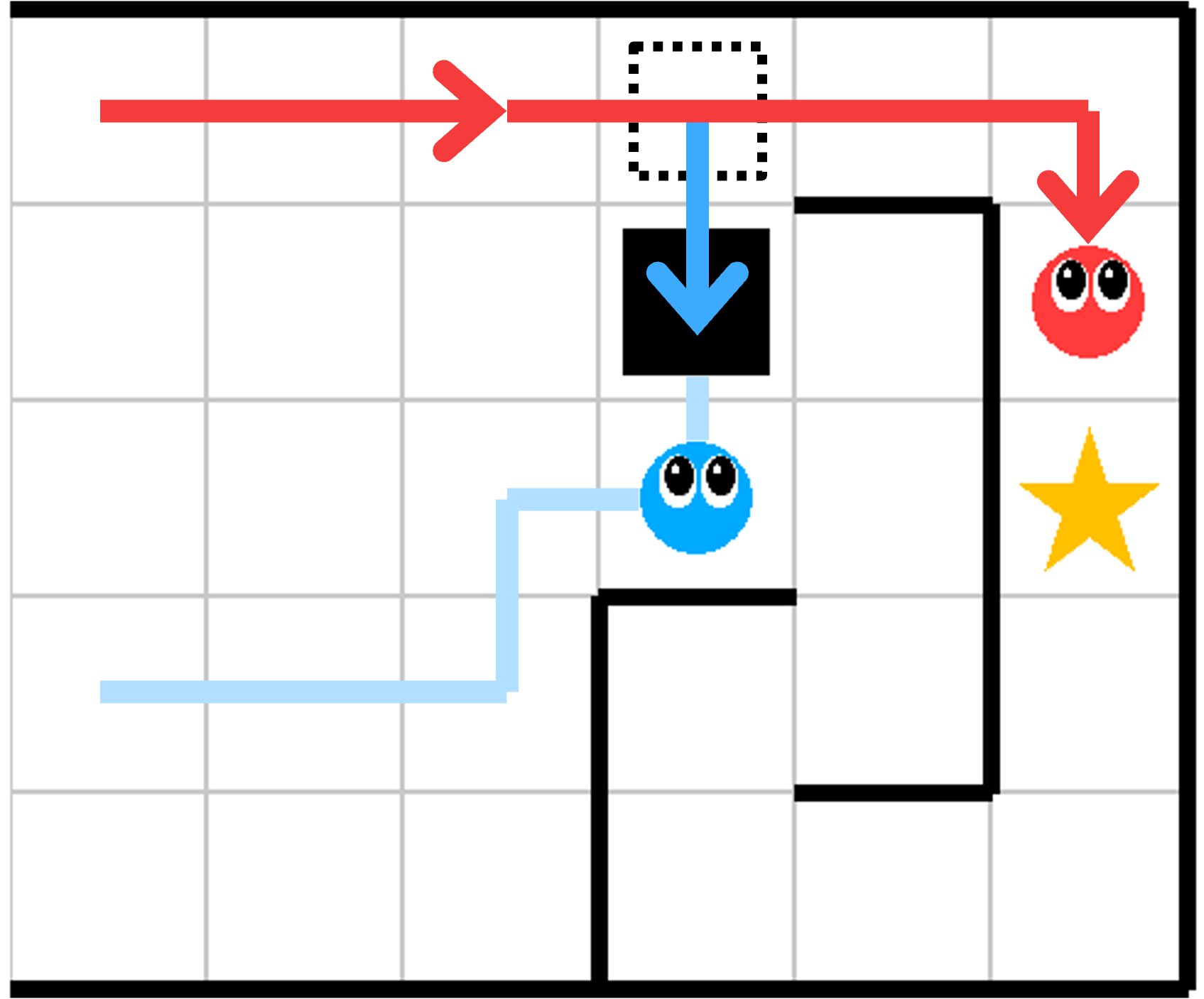

« Par exemple, pour tester leur compréhension de la physique intuitive, nous avons donné aux modèles des images de tours de bloc et leur avons demandé de juger si une tour donnée est stable ou non », a expliqué Buschoff et Akata.

« Pour le raisonnement causal et la psychologie intuitive, les modèles avaient besoin de déduire les relations entre les événements ou de comprendre les préférences d’autres agents. Nous avons ensuite évalué leurs performances de base et les avons comparées aux participants humains qui ont participé aux mêmes expériences. »

En comparant les réponses des LLM pendant les tâches avec celles données par les participants humains, les chercheurs ont pu mieux comprendre les façons dont les modèles étaient alignés avec les humains et où ils ont échoué.

Dans l’ensemble, leurs résultats ont montré que bien que certains modèles soient bons pour traiter les données visuelles de base, ils avaient encore du mal à imiter des aspects plus complexes de la cognition humaine.

« À ce stade, il n’est pas clair si c’est quelque chose qui peut être résolu par l’échelle et plus de diversité dans les données de formation », a déclaré Buschoff et Akata.

« Cela alimente un débat plus large sur les types de biais inductifs dont ces modèles doivent être équipés. Par exemple, certains soutiennent que ces modèles doivent être équipés de certains modules de traitement de base tels qu’un moteur physique, afin qu’ils atteignent un général Et une compréhension robuste du monde physique.

Les travaux récents de Buschoff, Akata et leurs collègues offrent de nouveaux informations précieux sur la mesure dans laquelle les LLM multi-modales de pointe actuelles présentent des compétences cognitives humaines. Jusqu’à présent, l’équipe a testé des modèles qui ont été formés sur de grands ensembles de données, mais ils aimeraient bientôt effectuer des tests supplémentaires sur des modèles qui ont été affinés sur les mêmes types de tâches utilisées dans les expériences.

« Nos premiers résultats avec un réglage fin montrent qu’ils deviennent beaucoup meilleurs dans la tâche spécifique sur laquelle ils sont formés », a ajouté Buschoff et Akata.

« Cependant, ces améliorations ne se traduisent pas toujours par une compréhension plus large et plus généralisée entre différentes tâches, ce que les humains font remarquablement bien. »