Les chercheurs universitaires trouvent un moyen de former un modèle de raisonnement d’IA pour moins de 50 $

Une petite équipe de chercheurs de l’IA de l’Université de Stanford et de l’Université de Washington a trouvé un moyen de former un modèle de raisonnement en IA pour une fraction du prix payé par les grandes sociétés qui produisent des produits largement connus tels que Chatgpt. Le groupe a publié un article sur le arxiv Préprint Server décrivant leurs efforts pour former des chatbots à peu de frais et d’autres modèles de raisonnement d’IA.

Des sociétés telles que Google et Microsoft ont clairement indiqué leur intention d’être des leaders dans le développement de chatbots avec des compétences en constante amélioration. Ces efforts sont notoirement chers et ont tendance à impliquer l’utilisation de fermes de serveurs à forte intensité d’énergie.

Plus récemment, une entreprise chinoise appelée Deepseek a publié un LLM égal en capacités à celles produites par des pays de l’Occident s’est développée à un coût bien inférieur. Cette annonce a envoyé le cours des actions pour de nombreuses entreprises technologiques dans un nezive.

Dans cette nouvelle étude, les chercheurs affirment qu’il est possible de former un LLM avec des capacités similaires à celles fabriquées par Openai ou Deepseek pour moins de 50 $. La capture est que les chercheurs sur ce nouvel effort ont utilisé un processus de distillation pour extraire les capacités d’un autre modèle d’IA.

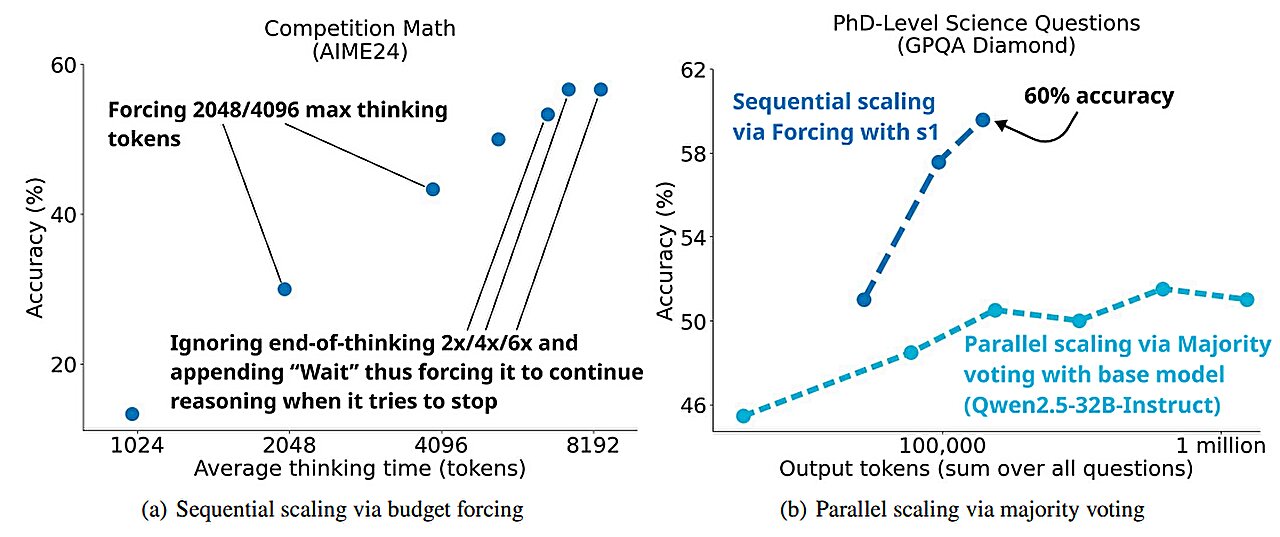

Pour former une IA à peu de frais, l’équipe de recherche a commencé par un modèle d’IA standard fabriqué par Alibaba, une entreprise appartenant à la Chine, qui a créé le modèle de test librement disponible. L’équipe de recherche a modifié le modèle et a appelé le résultat S1.

Une formation préliminaire a impliqué 1 000 paires de questions et réponses qu’ils avaient conçues avec soin pour donner à leur modèle une longueur d’avance sur l’apprentissage. Ils lui ont également donné le « processus de réflexion » Derrière Gemini 2.0, un modèle expérimental Google disponible librement. Ils l’ont ensuite entraîné en seulement 26 minutes en utilisant 16 GPU NVIDIA H100.

L’équipe a également cloué sur ce qu’ils appellent un petit tour – ils ont ajouté une étape appelée « pensée » Cela s’exécute avant que le modèle ne réponde – il donne au modèle le temps de vérifier son travail. Le résultat, selon les chercheurs, est un modèle d’IA à égalité avec d’autres produits beaucoup plus connus, fabriqués à une fraction du coût.