L’IA s’appuie sur l’horizon le grand saut technologique suivant des téléphones mobiles: 32 Go de RAM

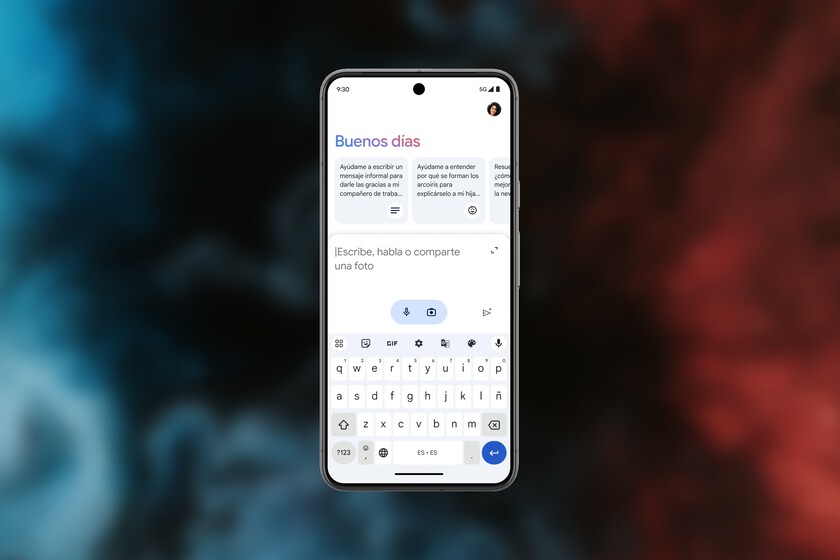

Il y a un an, nos mobiles ont des fonctions d’IA. Google les propose avec des Gémeaux et Apple (plus ou moins) avec Apple Intelligence, mais pour l’instant ces fonctions sont limitées et sont réduites à des tâches quelque peu modestes.

Cependant, nous voyons comment nos PC ont accès à des modèles plus frappants. La comparaison récente que nous avons faite de Deepseek R1-14B avec des modèles comme il appelle 3.1-8b ou PHI 4-14B a montré que ces développements pouvaient vraiment fonctionner bien dans un Mac Mini M4 avec 16 Go de RAM.

Cependant, ce qui se passe par exemple dans le pixel, c’est que Google propose son modèle Gemini Nano, qui a deux versions: un 1.8b et un autre 3.25b. Ce sont des modèles décents, mais ils sont encore clairement inférieurs aux avantages de modèles tels que Deepseek-R1-14B et d’autres comme ceux mentionnés.

Le problème est que ces modèles, surtout lorsque nous commençons à augmenter la taille et le nombre de paramètres (14b, par exemple), Ils ont besoin de mémoire. Et assez. Un LLM de sept milliards de paramètres (7b) a généralement besoin d’environ 8 Go de mémoire, bien qu’ici ait plus de marge de manœuvre (par exemple, 12 Go).

Les fabricants le savent, et en fait même Apple y a fait un petit effort. Dans l’iPhone 16, le saut de 6 à 8 Go l’a fait en grande partie à cause de cela, et le Pixel 9 de Google propose jusqu’à 16 Go de RAM précisément pour la même raison: cela donne une marge de manœuvre afin que les fonctions de l’exécuté dans la boîte locale fonction avec fluidité.

Mais ce saut pourrait bientôt aller plus. Il ne semble pas déraisonnable de penser que Plus tôt que tard, voyons les mobiles avec au moins 32 Go de RAM Précisément pour pouvoir exécuter des modèles d’IA plus grands et offrir ainsi aux utilisateurs des options plus puissantes à cet égard.

Bien sûr, non seulement la quantité de mémoire est importante. Nos téléphones mobiles n’ont pas de GPU dédié qui peut accélérer ces tâches, mais beaucoup progressent dans le développement de NPU de plus en plus puissants. La combinaison des deux éléments semble permettre un changement important dans l’offre de modèles locaux de plus en plus polyvalents.

Ces améliorations matérielles dans nos mobiles rejoignent également les techniques d’optimisation possibles et la «compression» des modèles d’IA. La quantification, une sorte d’arrondi, permet aux modèles de grande langue (LLM) de voir leur taille réduite, oui, de la perte d’un certain niveau de précision.

Le quantification Il s’agit d’un processus déjà très populaire lorsqu’il est en mesure d’utiliser de grands modèles dans des machines plus modestes, et en plus de réduire les exigences matérielles, elle permet également de gagner de l’efficacité.

Tout cela suggère un avenir pas trop lointain dans lequel nous aurons des modèles beaucoup plus puissants dans notre poche. Des modèles que nous pouvons exécuter à la maison, que nous pouvons même utiliser sans connexion Internet et qui maintiendront également toute la conversation en privé.

Il existe de nombreux avantages intéressants. Trop grand Ne pas penser que nous pouvons bientôt voir comment les fabricants mobiles présument 32 Go de mobile. Ou qui sait si encore plus.

Dans Simseo | Le nouveau Gémeaux démontre une ambition Google: que nous parlons sans nous arrêter avec notre mobile