L’IA explicable peut améliorer la transparence de la détection des Fake Deep

Une nouvelle étude de l’université SRH met l’accent sur les avantages des systèmes d’IA explicables pour la détection fiable et transparente des Fakes Deep. Les décisions de l’IA peuvent être présentées de manière compréhensible à travers des analyses et des visualisations de fonctionnalités, favorisant ainsi la confiance dans les technologies de l’IA.

Une équipe de recherche dirigée par le professeur Dr. Alexander I. Iliev de l’Université de SRH, avec des contributions clés du chercheur Nazneen Mansoor, a développé une méthode innovante pour détecter Deepfakes. Dans l’étude récemment publiée dans la revue Sciences appliquéesles scientifiques présentent l’utilisation d’une intelligence artificielle explicable (IA explicable) pour accroître la transparence et la fiabilité dans l’identification du contenu médiatique manipulé.

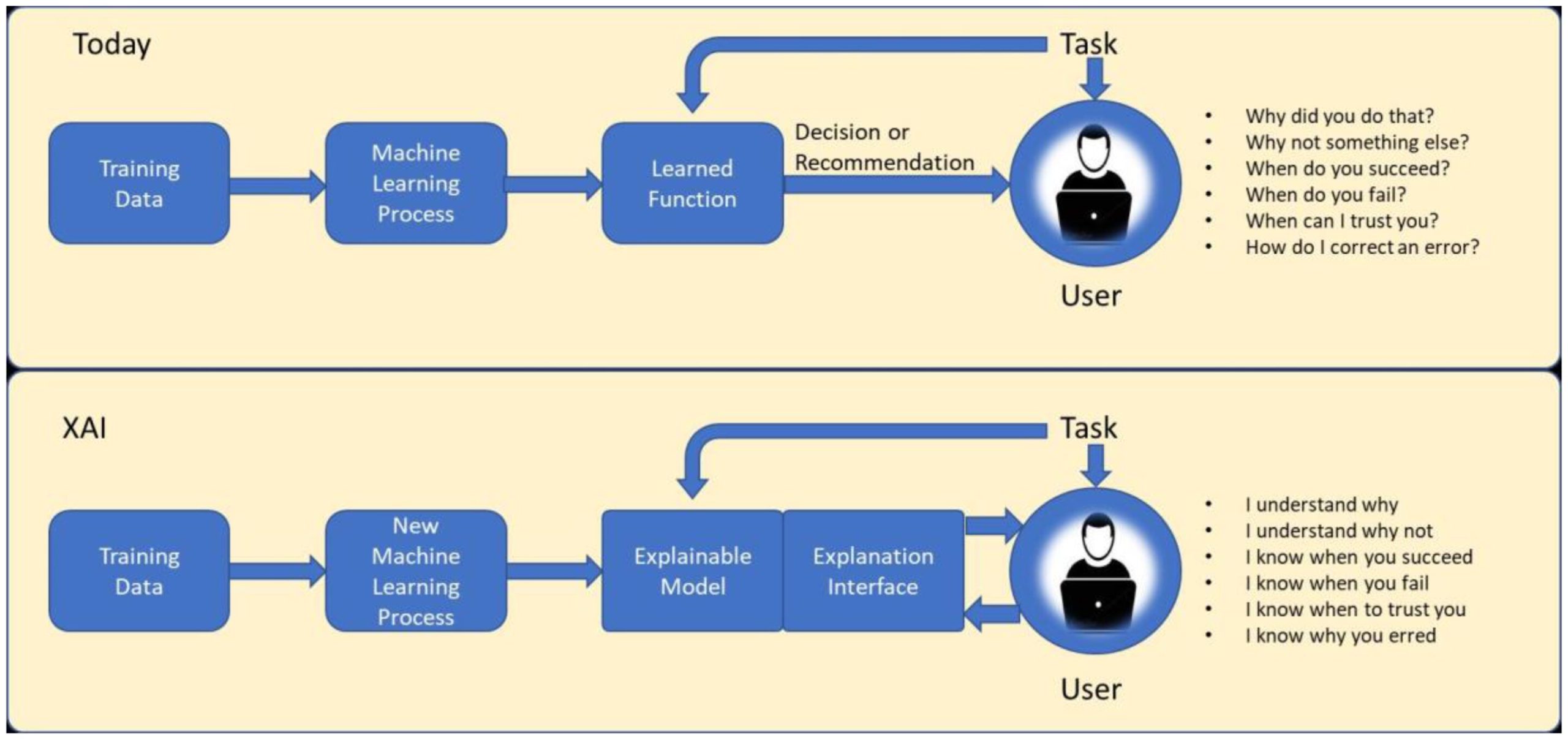

Deepfakes, c’est-à-dire, de faux contenus médiatiques tels que des vidéos ou des fichiers audio créés à l’aide de l’intelligence artificielle, constituent une menace croissante pour la société car elles peuvent être utilisées pour répandre la désinformation et saper la confiance du public. Les méthodes de détection conventionnelles atteignent souvent leurs limites, en particulier lorsqu’il s’agit de rendre les processus décisionnels des modèles d’IA compréhensibles.

Dans son étude, l’équipe de l’Université de SRH a effectué des tests approfondis dans lesquels différents modèles d’IA ont été testés pour leur capacité à identifier de manière fiable les FAKED. Une attention particulière a été accordée à une IA explicable, ce qui permet de présenter la base des décisions des modèles de manière transparente et compréhensible.

Cela se fait, par exemple, en utilisant des techniques de visualisation telles que des «cartes de chaleur», qui mettent en évidence en couleur dans les zones d’image que l’IA a identifiées comme pertinentes pour sa décision. De plus, les modèles explicables analysent des caractéristiques spécifiques telles que des textures ou des modèles de mouvement qui indiquent la manipulation.

Le professeur Dr. Iliev, chef de l’informatique – Big Data & Artificial Intelligence Master’s Program, explique l’importance de ces approches: « Notre objectif était de créer des technologies qui sont non seulement efficaces, mais aussi dignes de confiance. La capacité de prendre la décision- Le processus d’IA transparent devient de plus en plus important, que ce soit dans l’application des lois, l’industrie des médias ou en science. «

L’étude montre que l’IA explicable améliore non seulement la précision de la reconnaissance, mais favorise également la compréhension et la confiance dans les technologies d’IA. En montrant comment les décisions ont été prises, les faiblesses des modèles peuvent être identifiées et les futurs systèmes peuvent être optimisés de manière ciblée. Il s’agit d’une étape cruciale dans le renforcement de l’utilisation responsable de l’IA dans la société.

Fourni par l’Université SRH