Google a mis à jour ses principes pour l’IA, et la mention a disparu pour ne pas développer d’armes avec cette technologie

Au milieu de la rivalité croissante de l’industrie intelligence artificielle (IA), certaines entreprises ajustent leurs approches aux portées de cette technologie. L’année dernière, OpenAI a supprimé certaines conditions de sa politique avant d’annoncer un accord avec le Pentagone. Maintenant, c’est le tour de Google, qui a mis à jour ses «principes pour l’IA».

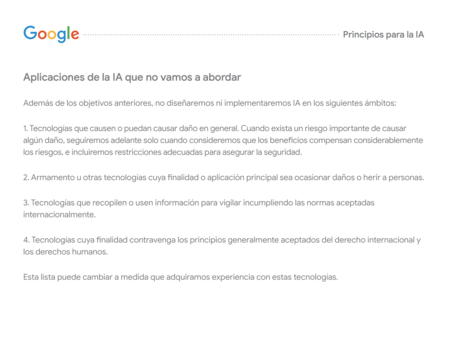

L’entreprise Mountain View a presque complètement repensé le document susmentionné, mais ce qui a le plus attiré l’attention, c’est l’absence de la catégorie « applications d’IA que nous n’allons pas aborder ». Comme son nom l’a suggéré, il a regroupé plusieurs domaines spécifiques dans lesquels IA ne serait pas conçu ou mis en œuvre pour en préserver le développement responsable.

Google, intelligence artificielle et armes

Comme nous pouvons le voir dans la capture, la liste originale incluait dans son premier élément «Technologies qui causent ou peuvent causer des dommages en général. Quand il y a un risque important de causer des dommagesnous ne continuerons que lorsque nous considérerons que les avantages compensent considérablement les risques, et nous inclurons des restrictions adéquates pour assurer la sécurité ».

Les éléments suivants ont indiqué «Armement ou d’autres technologies dont le but ou l’application principale est de causer des dommages ou de blesser les personnes, les technologies qui collectent ou utilisent des informations pour surveiller la violation des normes internationales acceptées, les technologies dont le but contrevient les principes généralement acceptés du droit et des droits internationaux humains « .

Les « applications AI que nous n’allons pas broder » dans le document original

Bloomberg, qui a été l’un des premiers moyens de détecter le changement, a demandé des commentaires à Google. La société a répondu par un article de blog signé par James Manyika, SVP de Google, et Demis Hassabis, qui dirige le laboratoire de Google Deepmind, qui parle de la Développement responsable de l’IA dans la démocratie et reportez-vous à la page avec les principes mis à jour.

« Nous reconnaissons la vitesse à laquelle la technologie sous-jacente et le débat sur les progrès, la mise en œuvre et les utilisations de l’IA continueront d’évoluer et de continuer à adapter et à affiner notre approche au fil du temps », a-t-il déclaré la société. Il convient de noter que de nouveaux contrats de défense n’ont pas été annoncés par Google.

Dans le passé, l’entreprise dirigée par Laster Pichai a travaillé avec le Pentagone dans le Projet Mavenqui devait utiliser l’IA pour traiter les données de diverses sources (principalement des drones), identifier les objectifs potentiels dans les zones de guerre et plus encore. Google a décidé de ne pas renouveler son contrat de collaboration avec le gouvernement américain après la protestation de ses propres employés.

Images | Google

Dans Simseo | L’UE alloue 52 millions d’euros pour créer sa propre IA et rivaliser avec les États-Unis et la Chine. C’est la même chose qu’Openai passe toutes les 48 heures