Deepseek, tout sur le modèle open source chinois qui remet en question OpenII

Il y a une nouvelle star dans le firmament de l’intelligence artificielle mondiale et le drapeau des étoiles et des rayures ne gagne pas dessus: c’est Profondeurun laboratoire de chinois d’IA qui se développe Modèles linguistiques open source avancés.

Fondée en 2023 dans le cadre du fonds quantitatif Voleur de haut niveauDeepseek a rapidement attiré l’attention mondiale avec ses modèles innovants; en particulier Deepseek-R1lancé en janvier 2025, alors maintenant toute la communauté de l’intelligence artificielle est en train de l’agitation.

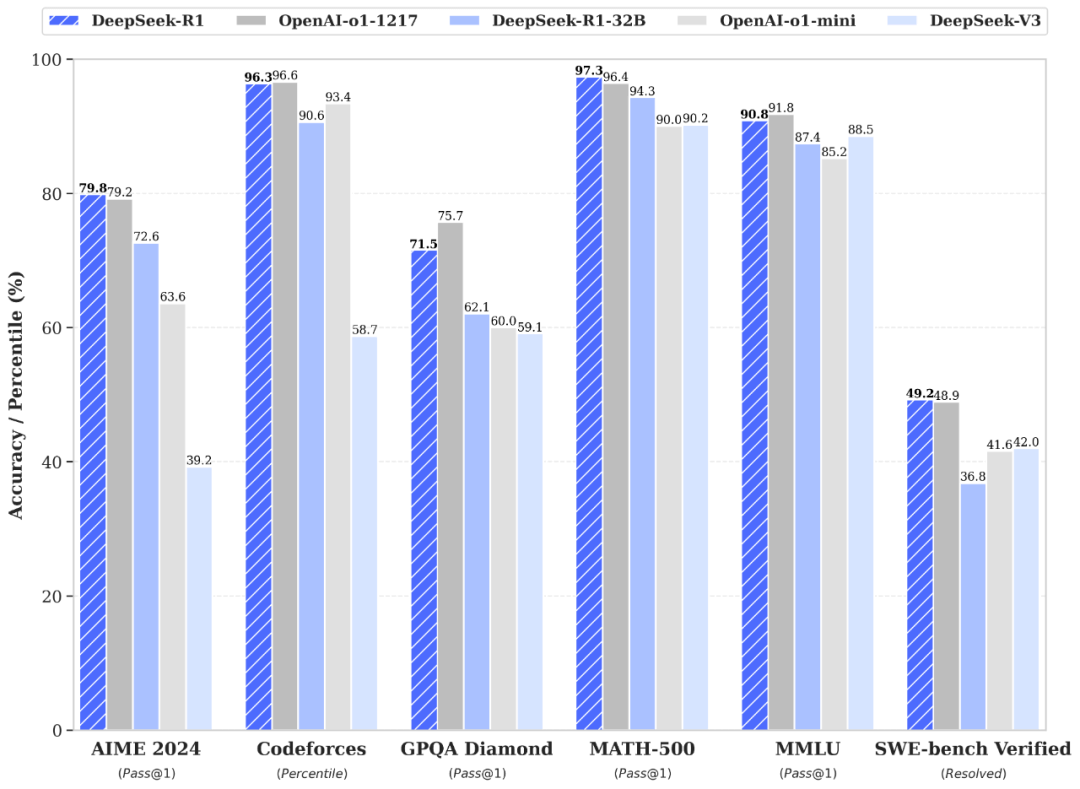

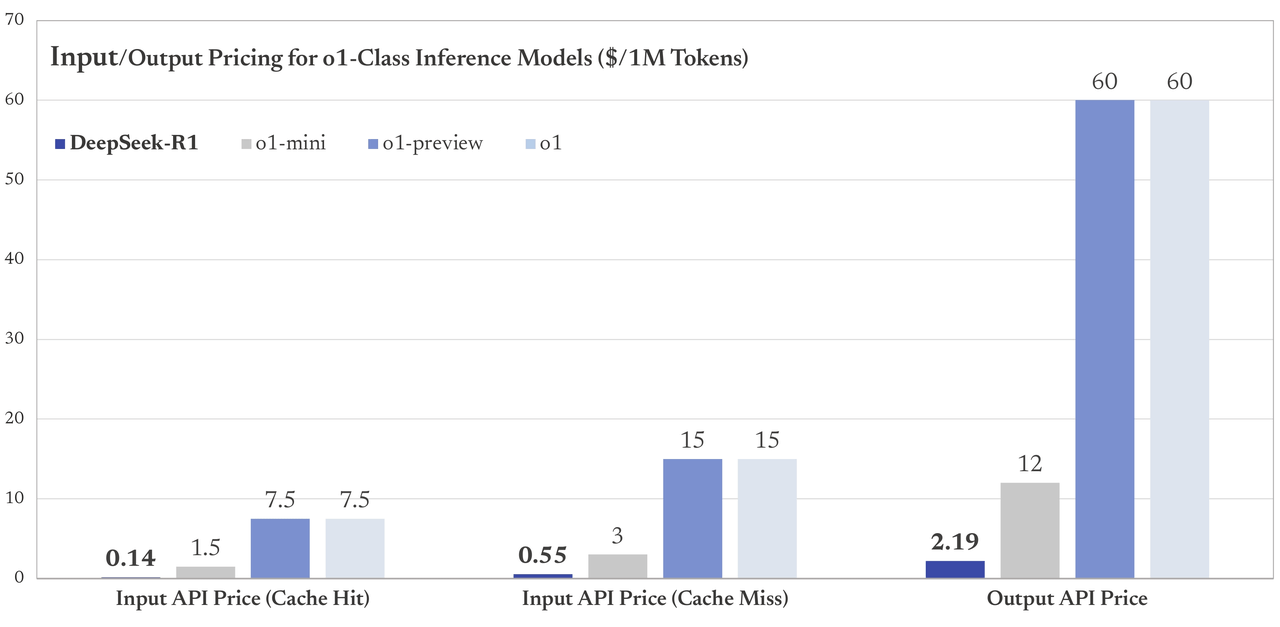

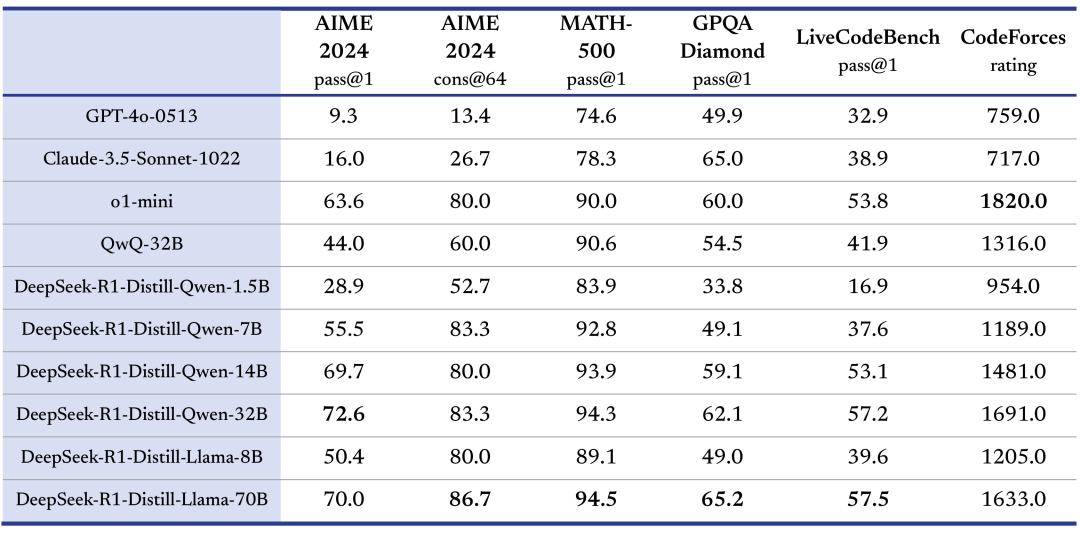

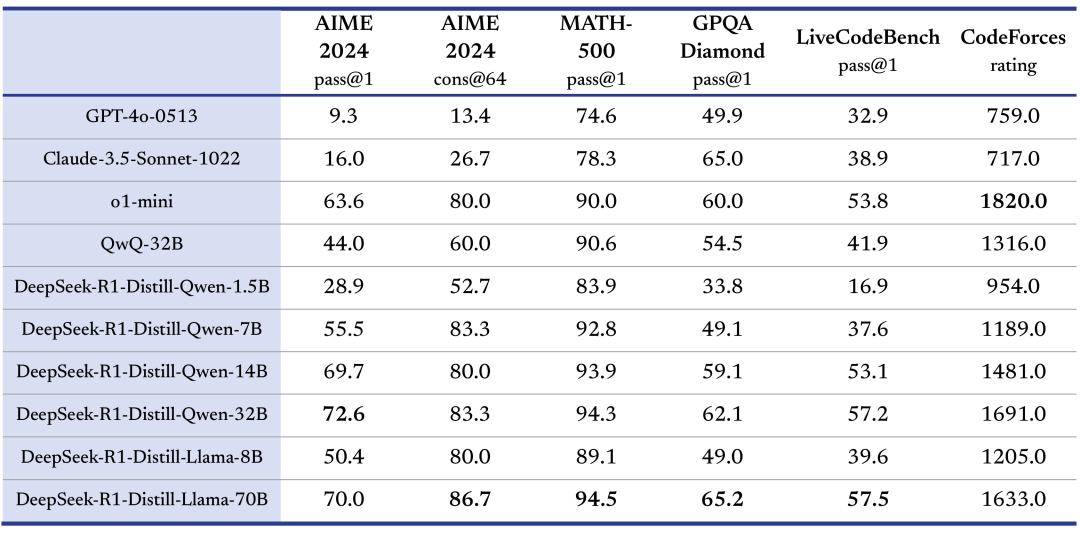

Parce que Deepseek affirme que R1 est égal ou même dépasse Openai-O1 sur plusieurs repères clés, mais il fonctionne à une fraction du coût. La Chine a ainsi montré qu’elle avait pu exploiter les restrictions à l’importation de puces imposées par les États-Unis à son avantage.

Deepseek-R1: les principales caractéristiques

Deepseek-R1 Utilisez une architecture appelée Mélange d’experts (MOE)qui active qu’une partie de son 671 milliards de paramètres Pendant le traitement. Cette approche vous permet de réduire considérablement les coûts de calcul, en activant uniquement 37 milliards de paramètres pour chaque pas en avant.

Le modèle est conçu pour exceller dans des tâches complexes telles que raisonnement mathématique et génération de code. Utiliser des techniques de Apprentissage pour le renforcement (RL) Pour développer des compétences de raisonnement autonome et une réflexion, la rendant compétitive avec des modèles tels que OpenII-O1.

Le modèle utilise une approche Chaîne de pensée Semblable à celui utilisé par OpenAI-O1, ce qui lui permet de résoudre des problèmes en développant des demandes étape par étape.

Deepseek-R1 offre des tarifs nettement inférieurs à ceux des concurrents, avec un coût de jeton qui est approximativement 27 fois inférieur à celui d’OpenII. Les utilisateurs peuvent envoyer jusqu’à 50 messages gratuits par jour.

Deepseek offre la possibilité d’essayer ses modèles via une application Web et une application mobile sans coûts apparents. Les utilisateurs peuvent charger des documents jusqu’à 100 Mo Pour l’extraction du texte, mais ne peut pas joindre de fichiers en mode « Deepthink » (qui active les compétences de raisonnement).

Dimitris Papiliopoulosle principal chercheur du Microsoft Frontiers Research Laboratory, déclare que ce qui l’a surpris plus que R1, c’est sa simplicité d’ingénierie. « Deepseek vise à obtenir des réponses précises plutôt que de détailler chaque étape logique, réduisant considérablement le temps de calcul et tout en maintenant un niveau d’efficacité élevé », dit-il.

Deepseek, les origines

Basé à Hangzhou, Deepseek est né de Voleur de haut niveauun Hedge fund Chinois qui utilise l’intelligence artificielle pour analyser les données financières. La transition vers la recherche sur l’IA a été dirigée par le fondateur Liang Wenfengun ancien étudiant de l’Université du Zhejiang avec une formation en informatique et en génie électronique, qui voulait explorer le potentiel de la science fondamentale plutôt que de se concentrer exclusivement sur les rendements financiers immédiats. Deepseek est principalement financé par le haut-voleur et les travaux indépendamment des grandes entreprises technologiques chinoises telles que Baidu Et Alibaba. Cette approche a permis à l’entreprise de maintenir une certaine liberté dans la recherche et le développement de ses modèles.

Comme Sam Altman par Openai, Liang vise à construire l’intelligence artificielle générale (AGI).

Deepseek est publié en six versions

Deepseek a également publié six versions plus petites que R1, assez pour être effectué localement sur les ordinateurs portableset prétend que l’un d’eux dépasse même O1-Mini d’Openai dans une référence. « Deepseek a répondu O1-Mini dans une large mesure et a fait une open source », a-t-il tweeté le PDG de PerplexitéAravind Srinivas.

Comme Deepseek R1 a dépassé les sanctions américaines

Le succès de Deepseek est encore plus remarquable si nous considérons les contraintes auxquelles les sociétés de renseignement artificiel chinois doivent être confrontées en raison des contrôles croissants des exportations de puces par les États-Unis. Le succès de Deepseek montre que ces mesures ne fonctionnent pas comme prévu: au lieu d’affaiblir les compétences de l’IA Chine, les pénalités semblent pousser les startups à innover de manière à favoriser l’efficacité, le partage des ressources et la collaboration.

Pour créer R1, Deepseek a dû retravailler le processus de formation pour réduire l’effort sur ses GPUune variété émise par Nvidia Pour le marché chinois qui a des performances limitées dans la moitié de la vitesse de ses produits phares, selon Zihan Wang, un ancien employé de Deepseek et doctorant actuel à la Northwestern University.

Deepseek R1 a été félicité par les chercheurs pour sa capacité à faire face à des tâches de raisonnement complexes, en particulier en mathématiques et en codage.

La formation de Grands modèles linguistiques (LLM) Il nécessite une équipe de chercheurs hautement qualifiés et une puissance de calcul remarquable. La situation est encore compliquée par les contrôles américains des exportations de semi-conducteurs avancés. La décision de High Flyer de s’aventurer dans l’IA est cependant directement connecté à ces contraintes. Bien avant les pénalités, Liang a acheté un approvisionnement considérable Puce nvidia a100un type maintenant interdit d’exporter vers la Chine.

Deepseek devrait avoir une quantité de ces puces entre 10 mille et 50 000 unités. La reconnaissance du potentiel de ces stocks pour la formation de l’IA a poussé Liang à fonder Deepseek, qui a pu les utiliser en combinaison avec les puces de puissance inférieures pour développer ses modèles.

Dans Une interview avec la moyenne chinoise 36 kr en juillet 2024Liang a déclaré qu’un autre défi auquel les entreprises chinoises sont confrontées, en plus des sanctions, est que leurs techniques d’ingénierie de l’intelligence artificielle ont tendance à être moins efficaces. «Nous (la plupart des entreprises chinoises), nous devons consommer le double du pouvoir de calcul pour obtenir les mêmes résultats. Si les lacunes dans l’efficacité des données sont ajoutées, cela pourrait signifier que nous avons besoin d’une puissance de calcul jusqu’à quatre fois plus élevée. Notre objectif est de combler continuellement ces lacunes « , a-t-il déclaré.

Mais Deepseek a trouvé un moyen de réduire l’utilisation de la mémoire et d’accélérer les calculs sans sacrifier considérablement la précision. « L’équipe aime transformer un défi matériel en une opportunité d’innovation », explique Wang.

Liang lui-même reste profondément impliqué dans le processus de recherche en profondeur, menant des expériences avec son équipe. « L’ensemble de l’équipe partage une culture collaborative et un dévouement à des recherches difficiles », explique Wang.

La Chine est en deuxième place parmi les producteurs de l’IA

En plus de donner la priorité à l’efficacité, les entreprises chinoises adoptent de plus en plus les principes de la source ouverte. Nuage d’alibaba Il a publié plus de 100 nouveaux modèles d’intelligence artificielle open source, qui prennent en charge 29 langues et se tournent vers diverses applications, y compris le codage et les mathématiques. De même, les startups comme Minima Et 01.ai Ils ont rendu leurs modèles disponibles.

Selon un livre blanc publié l’année dernière par Académie chinoise des technologies de l’information et des communicationsun institut de recherche affilié à l’État, le nombre de modèles d’IA dans le monde a atteint 1 328, dont 36% proviennent de la Chine. La Chine se place ainsi à la deuxième place Parmi les principaux contributeurs à l’IA, après les États-Unis.

« Le contrôle des exportations des États-Unis a considérablement mis les entreprises chinoises dans un coin, les forçant à être beaucoup plus efficaces avec leurs ressources informatiques limitées », dit-il Matt SheehaN, chercheur de l’IA au Carnegie Endowment for International Peace. « À l’avenir, nous assisterons probablement à une forte consolidation liée au manque de calcul ».

Cela a peut-être déjà commencé. Il y a deux semaines, Alibaba Cloud a annoncé qu’il avait serré un partenariat avec la startup 01.ai, fondée par Kai-Fu Lee et basée à Pékin, pour unir les équipes de recherche et créer un « laboratoire industriel de grands modèles ».

« Il est efficace d’un point de vue énergétique et naturel qui émerge une sorte de division du travail dans le secteur de l’IA », explique Cao, professeur de Tufts. « L’évolution rapide de l’IA nécessite l’agilité aux entreprises chinoises pour survivre ».

Conclusions

Deepseek représente un pas en avant significatif dans le panorama de l’intelligence artificielle, en particulier dans le domaine des modèles linguistiques open source. En mettant l’accent sur l’efficacité, les performances élevées et l’accessibilité, il pourrait influencer considérablement l’avenir du développement de l’IA en Chine et dans le monde. Cependant, il est important de noter qu’en opérant en Chine, Deepseek doit être conforme aux réglementations locales concernant le contenu et la censure.