L’IA incarnée révèle comment les robots et les tout-petits apprennent à comprendre

Nous, les humains, excellent à la généralisation. Si vous avez enseigné à un tout-petit à identifier la couleur rouge en lui montrant une boule rouge, un camion rouge et une rose rouge, elle identifiera très probablement correctement la couleur d’une tomate, même si c’est la première fois qu’elle en voit une.

Une étape importante dans l’apprentissage de la généralisation est la compositionnalité: la capacité de composer et de décomposer un ensemble en parties réutilisables, comme la rougeur d’un objet. La façon dont nous obtenons cette capacité est une question clé dans les neurosciences du développement et dans la recherche sur l’IA.

Les premiers réseaux de neurones, qui ont ensuite évolué vers les modèles de grande langue (LLMS) révolutionnant notre société, ont été développés pour étudier comment les informations sont traitées dans notre cerveau. Ironiquement, à mesure que ces modèles sont devenus plus sophistiqués, les voies de traitement de l’information à l’intérieur sont également devenues de plus en plus opaques, certains modèles ayant aujourd’hui des milliards de paramètres accordables.

Mais maintenant, les membres de l’unité de recherche cognitive en neurorobotiques de l’Institut d’Okinawa des sciences et de la technologie (OIST) ont créé un modèle d’intelligence incarné avec une nouvelle architecture qui permet aux chercheurs d’accéder aux différents états internes du réseau neuronal, et qui semble apprendre Comment généraliser de la même manière que les enfants.

Leurs résultats ont été publiés dans Robotique scientifique.

« Cet article démontre un mécanisme possible pour les réseaux de neurones pour atteindre la compositionnalité », explique le Dr Prasanna Vijayaraghavan, premier auteur de l’étude. « Notre modèle y parvient non pas par l’inférence basée sur de vastes ensembles de données, mais en combinant le langage avec la vision, la proprioception, la mémoire de travail et l’attention, tout comme les tout-petits. »

Parfaitement imparfait

LLMS, fondée sur une architecture de réseau transformateur, apprend la relation statistique entre les mots qui apparaissent dans les phrases à partir de grandes quantités de données de texte. Ils ont essentiellement accès à chaque mot dans tous les contextes imaginables, et à partir de cette compréhension, ils prédisent la réponse la plus probable à une invite donnée.

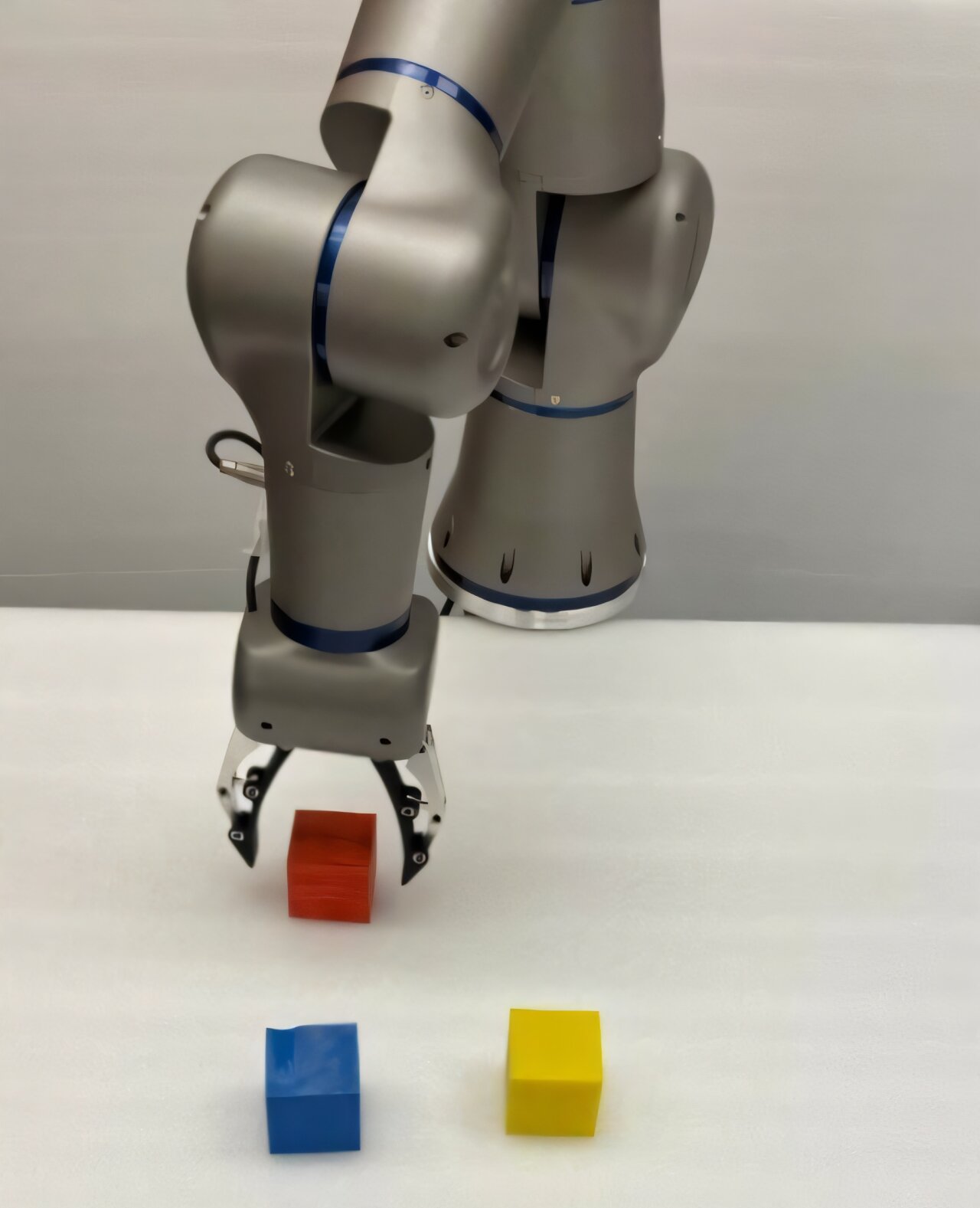

En revanche, le nouveau modèle est basé sur un cadre de réseau neuronal récurrent PV-RNN (codage prédictif inspiré, formé par des interactions incorporées intégrant trois entrées simultanées liées à différents sens: vision, avec une vidéo d’un bras de robot en mouvement en mouvement des blocs colorés en mouvement en mouvement en mouvement en mouvement en mouvement de couleur en mouvement en mouvement en mouvement en mouvement de couleur en mouvement de couleurs en mouvement de Robot ARM en mouvement des blocs colorés en mouvement des blocs en mouvement en mouvement de Robot En mouvement coloré en mouvement des blocs colorés en mouvement des boucles de robot en mouvement des blocs en mouvement en mouvement de couleurs en mouvement des blocs en mouvement de Robot ARM en mouvement des blocs colorés en mouvement des blocs en mouvement de Robot En mouvement coloré en mouvement des blocs colorés en mouvement des boucles de robot en mouvement des blocs en mouvement en mouvement de couleurs en mouvement des blocs en mouvement de Robot En mouvement coloré en mouvement des blocs colorés en mouvement des Robot ARMO ; Proprioception, le sens du mouvement de nos membres, avec les angles articulaires du bras du robot lorsqu’il se déplace; et une instruction linguistique comme « mettre du rouge sur le bleu ».

Le modèle est ensuite chargé de générer soit une prédiction visuelle et des angles articulaires correspondants en réponse à une instruction linguistique, soit à une instruction de langue en réponse à l’entrée sensorielle.

Le système est inspiré par le principe d’énergie libre, ce qui suggère que notre cerveau prédit continuellement les entrées sensorielles basées sur des expériences passées et prend des mesures pour minimiser la différence entre la prédiction et l’observation. Cette différence, quantifiée en «énergie libre», est une mesure de l’incertitude, et en minimisant l’énergie libre, notre cerveau maintient un état stable.

Avec la mémoire de travail limitée et la durée d’attention, l’IA reflète les contraintes cognitives humaines, la forçant à traiter les entrées et à mettre à jour sa prédiction dans la séquence plutôt qu’à tout un seul comme les LLM.

En étudiant le flux d’informations dans le modèle, les chercheurs peuvent mieux comprendre comment il intègre les différentes entrées pour générer ses actions simulées.

C’est grâce à cette architecture modulaire que les chercheurs ont appris davantage sur la façon dont les nourrissons peuvent développer la compositionnalité.

Comme le raconte le Dr Vijayaraghavan, « nous avons constaté que plus le modèle a exposé au même mot dans différents contextes, mieux il apprend ce mot. Cela reflète la vie réelle, où un enfant en bas âge apprendra le concept de la couleur Red beaucoup plus rapidement si Elle a interagi avec divers objets rouges de différentes manières, plutôt que de simplement pousser un camion rouge à plusieurs reprises. «

Ouvrir la boîte noire

« Notre modèle nécessite un ensemble de formation beaucoup plus petit et beaucoup moins de puissance de calcul pour atteindre la compositionnalité. Il fait plus d’erreurs que les LLM, mais il fait des erreurs similaires à la façon dont les humains font des erreurs », explique le Dr Vijayaraghavan.

C’est exactement cette fonctionnalité qui rend le modèle si utile aux scientifiques cognitifs, ainsi qu’aux chercheurs de l’IA essayant de cartographier les processus décisionnels de leurs modèles.

Bien qu’il sert un objectif différent de la LLMS actuellement utilisée et ne peut donc pas être comparée de manière significative sur l’efficacité, le PV-RNN montre néanmoins comment les réseaux neuronaux peuvent être organisés pour offrir une plus grande idée de leurs voies de traitement de l’information: son architecture relativement peu profonde permet aux chercheurs Pour visualiser l’état latent du réseau – l’évolution de la représentation interne des informations conservées du passé et utilisées dans les prévisions actuelles.

Le modèle aborde également le problème de la pauvreté du stimulus, qui postule que l’apport linguistique à la disposition des enfants est insuffisant pour expliquer leur acquisition rapide du langage. Malgré un ensemble de données très limité, en particulier par rapport aux LLM, le modèle atteint toujours la compositionnalité, ce qui suggère que la mise en œuvre du langage dans le comportement peut être un catalyseur important pour l’impressionnante capacité d’apprentissage des langues des enfants.

Cet apprentissage incarné pourrait en outre montrer la voie à une IA plus sûre et plus éthique à l’avenir, à la fois en améliorant la transparence et en étant capable de mieux comprendre les effets de ses actions. Apprendre le mot «souffrir» d’une perspective purement linguistique, comme le font les LLM, aurait moins de poids émotionnel que pour un PV-RNN, qui apprend le sens à travers des expériences incarnées avec le langage.

« Nous poursuivons notre travail pour améliorer les capacités de ce modèle et l’utiliser pour explorer divers domaines de neurosciences de développement. Nous sommes ravis de voir quelles informations futures sur le développement cognitif et les processus d’apprentissage des langues que nous pouvons découvrir », explique le professeur Jun Tani, Chef de l’unité de recherche et auteur principal sur le journal.

Comment nous acquérons l’intelligence pour créer notre société est l’une des grandes questions de la science. Bien que le PV-RNN n’ait pas répondu, il ouvre de nouvelles voies de recherche sur la façon dont les informations sont traitées dans notre cerveau.

« En observant comment le modèle apprend à combiner le langage et l’action », résume le Dr Vijayaraghavan, « nous avons un aperçu des processus fondamentaux qui sous-tendent la cognition humaine. Modèles plus efficaces, transparents et sûrs. «