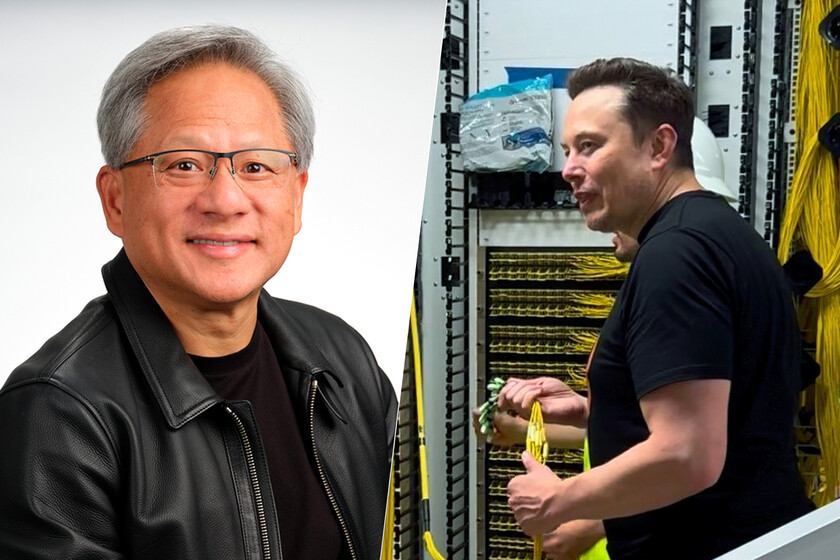

Choqué, Jensen Huang déclare qu'Elon Musk a installé 100 000 GPU NVIDIA en seulement 19 jours. Un tel déploiement prendrait des années.

Au début de l’année dernière, Elon Musk s’est lancé dans la course à l’intelligence artificielle (IA) avec sa propre entreprise appelée xAI. L'idée de l'homme d'affaires était de rivaliser avec OpenAI, Microsoft ou Googlemais pour affronter ce type de rivaux, il lui fallait un supercalculateur dont les performances soient à la hauteur. Après avoir lancé les premières versions de Grok, un rival de ChatGPT, xAI a lancé en juillet dernier le « cluster de formation en IA le plus puissant au monde », une bête dotée de 100 000 GPU NVIDIA H100 située à Memphis, dans le Tennessee.

Nous avons désormais plus de détails sur ce projet qui, comme nous l'avons vu, se développe contre la montre. L'information provient d'une conversation intéressante que le PDG de NVIDIA, Jensen Huang, a eue cette semaine avec les animateurs du podcast BG2. Le dirigeant a expliqué que l'équipe xAI est passée du stade de conception à l'intégration complète des 100 000 unités de traitement du cluster de Memphis en seulement 19 jours, une étape franchie avec la première tâche de formation, promue par Elon Musk en x.

Mettre en place un data center en 19 jours

Huang explique que le processus impliquait non seulement le montage des GPU, mais également l'équipement de l'installation d'un système de refroidissement liquide et d'un système d'alimentation afin que les puces puissent fonctionner. « Il n'y a qu'une seule personne au monde qui pourrait faire cela », a déclaré le PDG de la deuxième entreprise la plus valorisée en termes de capitalisation boursière, ajoutant qu'une grande partie de cette réussite était due à la collaboration de ses équipes avec le groupe. des équipes « excellentes » des logiciels, des réseaux et de l'infrastructure de la nouvelle société d'IA de Musk.

Les dimensions du travail réalisé peuvent être mieux comprises grâce à quelques données intéressantes fournies plus tard par Huang. Selon ses calculs, le démarrage d'un supercalculateur de 100 000 GPU prend généralement environ quatre ans. Trois années seraient consacrées à la planification, tandis que la dernière année consisterait à recevoir l'équipement, à l'installer et à le tester pour que tout fonctionne. Mettre en place un data center dédié au support de charges de travail élevées est un véritable défi, un défi qui implique de corriger les erreurs et de travailler sur l'optimisation.

Huang a également expliqué que l'intégration de 100 000 GPU H100 n'a « jamais été réalisée auparavant » et ne sera pas vue dans une autre entreprise avant un certain temps. Lorsque nous parlons du cluster xAI, nous faisons référence à une infrastructure dotée de la technologie d'accès direct à la mémoire à distance (RDMA), qui offre transferts de données rapides et efficacesce qui permet d'améliorer les performances. Un aspect clé est qu’il s’agit d’une solution évolutive, qui peut être étendue au fil du temps, probablement avec le GPU H200.

Images | Nvidia (1,2) | xAI

À Simseo | Différencier le contenu de l’IA sur Internet est de plus en plus difficile. La solution est quelque chose de similaire aux steaks