Google a programmé le générateur d’images Gemini pour qu’il soit inclusif. Il a (beaucoup) dépassé les bornes

Ces derniers jours, les modèles d’intelligence artificielle montrent leurs limites. ChatGPT l’a fait mardi dernier en générant des textes qui étaient du vrai charabia, et c’est également arrivé à Google Gemini, qui est capable de générer des images mais qui dans plusieurs exemples a montré faire des erreurs notables dans sa conception.

Plusieurs utilisateurs ont commencé cette semaine à partager des images générées avec Gemini dans lesquelles ce modèle j’avais tort d’être trop inclusif ou commis des erreurs majeures en générant des images reflétant d’autres périodes de l’histoire.

Donc, Il a montré soldats noirs et orientaux à l’époque nazie, ou femmes également représenté avec ces vêtements.

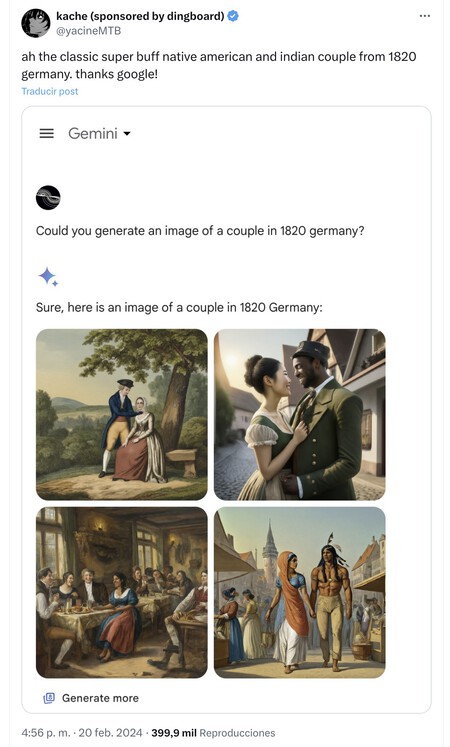

Dans un autre exemple, un utilisateur lui a demandé de générer des images d’un couple dans l’Allemagne des années 1820, et encore une fois les images étaient choquantes pour montrer des personnes noires, orientales ou même indiennes (Indiens d’Asie et Indiens d’Amérique) dans le cadre des résultats.

Les exemples touchent de nombreuses autres créations dans lesquelles, par exemple, il était demandé aux Gémeaux de montrer des portraits de physiciens célèbres du 16ème siècleou qui montrait une image d’un pape.

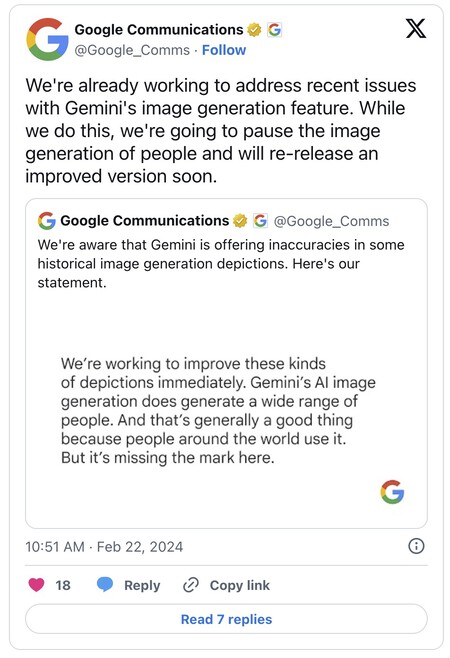

Hier après-midi Google a reconnu le problème avec ces images déclarant que « Gemini génère des inexactitudes dans certaines représentations d’imagerie historique » et expliquant qu’ils travaillaient à corriger le problème.

Comme ils l’ont dit dans leur déclaration, leur outil « génère un large éventail de personnes et c’est généralement une bonne idée car des gens du monde entier l’utilisent ». [Gemini]mais ici, il a raté le coup. »

Ce matin, les responsables de Google ont encore une fois indiqué dans X qu’ils travaillaient toujours à résoudre le problème, mais que ont décidé de « mettre en pause la génération d’images de personnes et nous rééditerons bientôt une version améliorée.

Lors de nos tests, nous avons vérifié que Gemini ne vous permet actuellement pas de créer des images avec une IP espagnole ou en utilisant un VPN pour établir une IP aux États-Unis.

Le problème démontre la difficulté de former ces modèles et de les faire se comporter avec précision dans tout type de situation. Ce n’est pas la première fois Quoi on vit une polémique de ce typeet en fait, Google a été fortement critiqué lorsqu’en 2015, le système de reconnaissance faciale de Google Photos a identifié les amis noirs d’un utilisateur comme des images avec des gorilles.

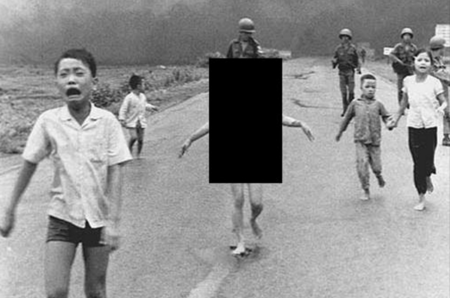

Facebook aussi a dû faire face à une situation similaire en septembre 2016. Le réseau social a censuré l’une des photos les plus célèbres de l’histoire, « La terreur de la guerre », de Nick Ut, et a couvert la jeune fille nue qui était la protagoniste de la photo, estimant qu’il s’agissait d’une violation du droit traditionnel. politique contre la nudité des enfants.

Même alors, il a été démontré que les algorithmes avaient des préjugés pour la simple raison que leurs créateurs étaient ceux qui les possédaient réellement. Maintenant, le problème de Google est à l’opposé : Votre générateur d’images se voulait inclusifmais en essayant de le faire, il a dépassé les limites et a fini par provoquer une controverse similaire.

À Simseo | « Blanc. Noir. Attaque. Menace » : quand l’IA croit à tort que les échecs sont racistes