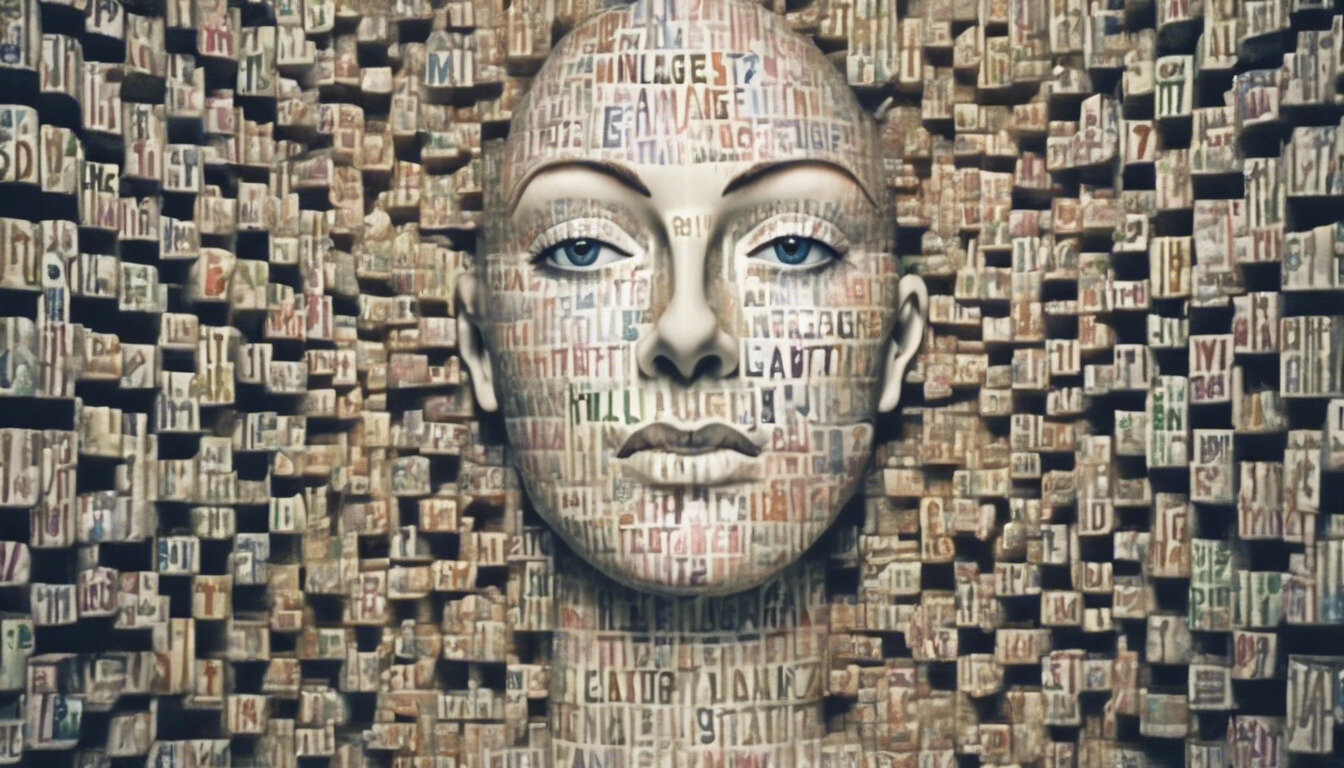

Les outils d’IA produisent des résultats éblouissants, mais ont-ils vraiment une « intelligence » ?

Sam Altman, directeur général d’OpenAI, fabricant de ChatGPT, tenterait de trouver jusqu’à 7 000 milliards de dollars d’investissement pour fabriquer les énormes volumes de puces informatiques dont il estime que le monde a besoin pour faire fonctionner les systèmes d’intelligence artificielle (IA). Altman a également récemment déclaré que le monde aurait besoin de plus d’énergie dans l’avenir saturé d’IA qu’il envisage – bien plus qu’une sorte de percée technologique comme la fusion nucléaire pourrait être nécessaire.

Altman a clairement de grands projets pour la technologie de son entreprise, mais l’avenir de l’IA est-il vraiment aussi rose ? En tant que chercheur de longue date en « intelligence artificielle », j’ai des doutes.

Les systèmes d’IA d’aujourd’hui, en particulier les outils d’IA générative tels que ChatGPT, ne sont pas vraiment intelligents. De plus, rien ne prouve qu’ils puissent le devenir sans des changements fondamentaux dans leur façon de travailler.

Qu’est-ce que l’IA ?

Une définition de l’IA est un système informatique capable « d’effectuer des tâches communément associées aux êtres intelligents ».

Cette définition, comme bien d’autres, est un peu floue : faut-il appeler les tableurs IA, car ils peuvent effectuer des calculs qui auraient autrefois été une tâche humaine de haut niveau ? Qu’en est-il des robots d’usine, qui ont non seulement remplacé les humains, mais qui, dans de nombreux cas, nous ont surpassés dans leur capacité à effectuer des tâches complexes et délicates ?

Même si les feuilles de calcul et les robots peuvent effectivement faire des choses qui étaient autrefois le domaine des humains, ils le font en suivant un algorithme, un processus ou un ensemble de règles permettant d’aborder une tâche et de l’accomplir.

Une chose que nous pouvons dire, c’est qu’il n’existe pas d’« IA » au sens de système capable d’effectuer une série d’actions intelligentes comme le ferait un humain. Il existe plutôt de nombreuses technologies d’IA différentes qui peuvent faire des choses très différentes.

Prendre des décisions ou générer des résultats

La distinction la plus importante est peut-être entre « l’IA discriminative » et « l’IA générative ».

L’IA discriminante aide à prendre des décisions, par exemple si une banque doit accorder un prêt à une petite entreprise ou si un médecin diagnostique un patient atteint d’une maladie X ou d’une maladie Y. Les technologies d’IA de ce type existent depuis des décennies, et de plus grandes et meilleures. émergent tout le temps.

Les systèmes d’IA générative, quant à eux – ChatGPT, Midjourney et leurs proches – génèrent des résultats en réponse aux entrées : en d’autres termes, ils inventent des choses. Essentiellement, ils ont été exposés à des milliards de points de données (tels que des phrases) et les utilisent pour deviner une réponse probable à une invite. La réponse peut souvent être « vraie », selon les données sources, mais il n’y a aucune garantie.

Pour l’IA générative, il n’y a pas de différence entre une « hallucination » – une fausse réponse inventée par le système – et une réponse qu’un humain jugerait vraie. Cela semble être un défaut inhérent à la technologie, qui utilise une sorte de réseau neuronal appelé transformateur.

L’IA, mais pas intelligente

Un autre exemple montre à quel point les objectifs de « l’IA » sont en constante évolution. Dans les années 1980, j’ai travaillé sur un système informatique conçu pour fournir des conseils médicaux experts sur les résultats de laboratoire. Il a été décrit dans la littérature de recherche américaine comme l’un des quatre premiers « systèmes experts » médicaux utilisés en clinique, et en 1986, un rapport du gouvernement australien l’a décrit comme le système expert le plus réussi développé en Australie.

J’en étais assez fier. Il s’agissait d’une référence en matière d’IA et il effectuait une tâche qui nécessitait normalement des spécialistes médicaux hautement qualifiés. Cependant, le système n’était pas du tout intelligent. Il s’agissait en réalité d’une sorte de table de consultation qui faisait correspondre les résultats des tests de laboratoire avec des conseils de haut niveau en matière de diagnostic et de prise en charge des patients.

Il existe désormais une technologie qui facilite grandement la construction de tels systèmes. Il en existe donc des milliers en usage dans le monde. (Cette technologie, basée sur mes recherches et celles de mes collègues, est fournie par une société australienne appelée Beamtree.)

En accomplissant une tâche effectuée par des spécialistes hautement qualifiés, ils sont certes des « IA », mais ils ne sont toujours pas du tout intelligents (même si les plus complexes peuvent avoir des milliers et des milliers de règles pour rechercher des réponses).

Les réseaux de transformateurs utilisés dans les systèmes d’IA générative fonctionnent toujours selon des ensembles de règles, même s’il peut y en avoir des millions ou des milliards, et elles ne peuvent pas être facilement expliquées en termes humains.

Qu’est-ce que la véritable intelligence ?

Si les algorithmes peuvent produire des résultats éblouissants comme ceux que nous voyons avec ChatGPT sans être intelligents, qu’est-ce que la véritable intelligence ?

Nous pourrions dire que l’intelligence est la perspicacité : le jugement selon lequel quelque chose est ou n’est pas une bonne idée. Pensez à Archimède, sautant de son bain et criant « Eurêka » parce qu’il avait compris le principe de la flottabilité.

L’IA générative n’a pas d’informations. ChatGPT ne peut pas vous dire si sa réponse à une question est meilleure que celle de Gemini. (Gemini, jusqu’à récemment connu sous le nom de Bard, est le concurrent de Google de la famille d’outils d’IA GPT d’OpenAI.)

Ou, pour le dire autrement : l’IA générative pourrait produire des images étonnantes dans le style de Monet, mais si elle était formée uniquement à l’art de la Renaissance, elle n’inventerait jamais l’impressionnisme.

L’IA générative est extraordinaire et les gens y trouveront sans aucun doute des utilisations répandues et très précieuses. Il fournit déjà des outils extrêmement utiles pour transformer et présenter (mais pas découvrir) des informations, et les outils permettant de transformer les spécifications en code sont déjà utilisés couramment.

Celles-ci s’amélioreront de plus en plus : Gemini, récemment publié par Google, par exemple, semble essayer de minimiser le problème des hallucinations, en utilisant la recherche, puis en réexprimant les résultats de la recherche.

Néanmoins, à mesure que nous nous familiariserons avec les systèmes d’IA générative, nous verrons plus clairement qu’ils ne sont pas vraiment intelligents ; il n’y a aucune idée. Il ne s’agit pas de magie, mais d’un tour de magie très astucieux : un algorithme qui est le produit d’une extraordinaire ingéniosité humaine.