L’apprentissage tout au long de la vie alimentera la prochaine génération d’appareils autonomes

Recherchez « apprentissage tout au long de la vie » en ligne et vous trouverez une longue liste d’applications pour vous apprendre à courtepointer, à jouer aux échecs ou même à parler une nouvelle langue. Cependant, dans les domaines émergents de l’intelligence artificielle (IA) et des appareils autonomes, « l’apprentissage tout au long de la vie » signifie quelque chose de différent et est un peu plus complexe. Il fait référence à la capacité d’un appareil à fonctionner en permanence, à interagir avec son environnement et à en tirer des leçons, seul et en temps réel.

Cette capacité est essentielle au développement de certaines de nos technologies les plus prometteuses, depuis les drones de livraison automatisés et les voitures autonomes jusqu’aux rovers et robots extraplanétaires capables d’effectuer un travail trop dangereux pour les humains.

Dans tous ces cas, les scientifiques développent des algorithmes à un rythme effréné pour permettre un tel apprentissage. Mais les accélérateurs matériels d’IA spécialisés, ou puces, dont les appareils ont besoin pour exécuter ces nouveaux algorithmes doivent suivre le rythme.

C’est le défi qu’a relevé Angel Yanguas-Gil, chercheur au Laboratoire national d’Argonne du Département américain de l’énergie (DOE). Son travail s’inscrit dans le cadre de l’Initiative Microélectronique d’Argonne. Yanguas-Gil et une équipe multidisciplinaire de collègues ont récemment publié un article dans Électronique naturelle qui explore les défis de programmation et de matériel auxquels sont confrontés les appareils basés sur l’IA, et comment nous pourrions être en mesure de les surmonter grâce à la conception.

Apprendre en temps réel

Les approches actuelles de l’IA sont basées sur un modèle de formation et d’inférence. Le développeur « entraîne » la capacité d’IA hors ligne à utiliser uniquement certains types d’informations pour effectuer un ensemble défini de tâches, teste ses performances, puis l’installe sur l’appareil de destination.

« À ce stade, l’appareil ne peut plus apprendre de nouvelles données ou expériences », explique Yanguas-Gil. « Si le développeur souhaite ajouter des fonctionnalités à l’appareil ou améliorer ses performances, il doit mettre l’appareil hors service et former le système à partir de zéro. »

Pour les applications complexes, ce modèle n’est tout simplement pas réalisable.

« Pensez à un rover planétaire qui rencontre un objet qu’il n’a pas été entraîné à reconnaître. Ou qui pénètre dans un terrain pour lequel il n’a pas été entraîné à naviguer », poursuit Yanguas-Gil.

« Étant donné le décalage entre le rover et ses opérateurs, l’arrêter et essayer de le recycler pour qu’il fonctionne dans cette situation ne fonctionnera pas. Au lieu de cela, le rover doit être capable de collecter de nouveaux types de données. Il doit relier ces nouveaux informations aux informations dont elle dispose déjà – et aux tâches qui y sont associées. Et puis prendre des décisions sur ce qu’il faut faire ensuite en temps réel.

Le défi est que l’apprentissage en temps réel nécessite des algorithmes beaucoup plus complexes. À leur tour, ces algorithmes nécessitent plus d’énergie, plus de mémoire et plus de flexibilité de la part de leurs accélérateurs matériels pour fonctionner. Et ces puces sont presque toujours strictement limitées en taille, en poids et en puissance, en fonction de l’appareil.

Clés pour les accélérateurs d’apprentissage tout au long de la vie

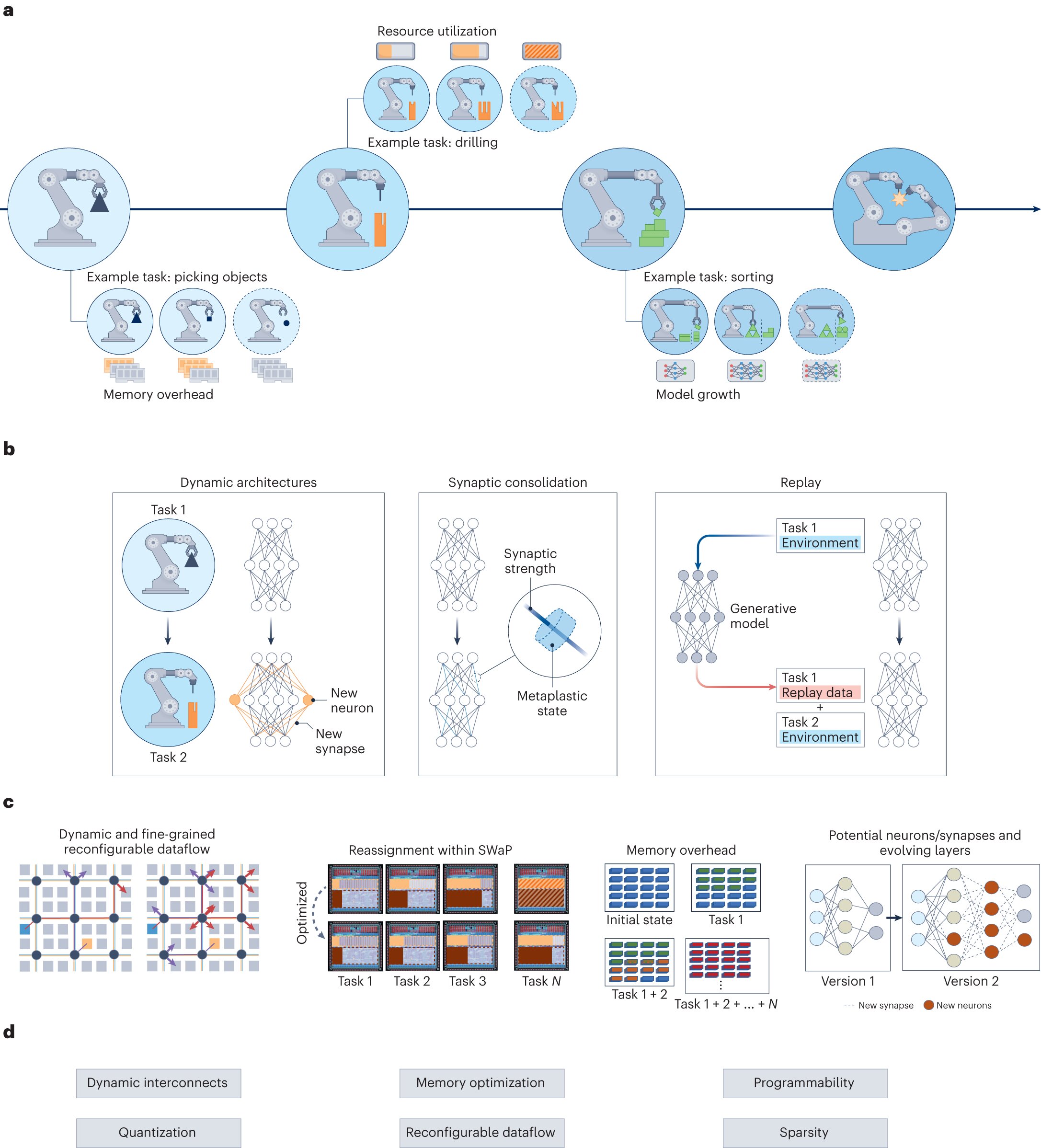

Selon le document, les accélérateurs d’IA ont besoin d’un certain nombre de capacités pour permettre à leurs appareils hôtes d’apprendre en continu.

La capacité d’apprentissage doit être située sur l’appareil. Dans la plupart des applications prévues, l’appareil n’aura pas le temps de récupérer des informations à partir d’une source distante comme le cloud ou de demander à l’opérateur une transmission contenant des instructions avant de devoir effectuer une tâche.

L’accélérateur doit également avoir la capacité de modifier la façon dont il utilise ses ressources au fil du temps afin de maximiser l’utilisation de l’énergie et de l’espace. Cela pourrait impliquer de décider de modifier l’endroit où il stocke certains types de données ou la quantité d’énergie qu’il utilise pour effectuer certaines tâches.

Une autre nécessité est ce que les chercheurs appellent la « récupérabilité du modèle ». Cela signifie que le système peut conserver suffisamment de sa structure d’origine pour continuer à accomplir les tâches prévues à un niveau élevé, même s’il change et évolue constamment en raison de son apprentissage. Le système devrait également empêcher ce que les experts appellent « l’oubli catastrophique », où l’apprentissage de nouvelles tâches amène le système à oublier les anciennes. C’est un phénomène courant dans les approches actuelles d’apprentissage automatique. Si nécessaire, les systèmes devraient pouvoir revenir à des pratiques plus efficaces si les performances commencent à souffrir.

Enfin, l’accélérateur pourrait avoir besoin de consolider les connaissances acquises lors de tâches précédentes (en utilisant les données des expériences passées via un processus appelé replay) tout en en accomplissant activement de nouvelles.

Toutes ces capacités présentent des défis pour les accélérateurs d’IA que les chercheurs commencent seulement à relever.

Comment sait-on que ça marche ?

Le processus de mesure de l’efficacité des accélérateurs d’IA est également un travail en cours. Dans le passé, les évaluations se concentraient sur l’exactitude des tâches afin de mesurer le degré d’oubli qui se produisait dans le système à mesure qu’il apprenait une série de tâches.

Mais ces mesures ne sont pas suffisamment nuancées pour capturer les informations dont les développeurs ont besoin pour développer des puces d’IA capables de relever tous les défis requis pour l’apprentissage tout au long de la vie. Selon le document, les développeurs sont désormais plus intéressés à évaluer dans quelle mesure un appareil peut utiliser ce qu’il apprend pour améliorer ses performances sur les tâches qui précèdent et suivent le point d’une séquence où il apprend de nouvelles informations. D’autres mesures émergentes visent à mesurer la rapidité avec laquelle le modèle peut apprendre et dans quelle mesure il gère sa propre croissance.

Des progrès face à la complexité

Si tout cela semble exceptionnellement complexe, eh bien, ça l’est.

« Il s’avère que pour créer des dispositifs capables d’apprendre réellement en temps réel, nous aurons besoin de percées et de stratégies allant de la conception d’algorithmes à la conception de puces en passant par de nouveaux matériaux et dispositifs », explique Yanguas-Gil.

Heureusement, les chercheurs pourraient être en mesure de s’inspirer ou d’adapter des technologies existantes conçues à l’origine pour d’autres applications, telles que les dispositifs de mémoire. Cela pourrait contribuer à réaliser des capacités d’apprentissage tout au long de la vie d’une manière compatible avec les technologies actuelles de traitement des semi-conducteurs.

De même, les nouvelles approches de co-conception développées dans le cadre du portefeuille de recherche d’Argonne en microélectronique peuvent contribuer à accélérer le développement de nouveaux matériaux, dispositifs, circuits et architectures optimisés pour l’apprentissage tout au long de la vie. Dans leur article, Yanguas-Gil et ses collègues proposent quelques principes de conception pour guider les efforts de développement dans ce sens. Ils comprennent:

- Architectures hautement reconfigurables, afin que le modèle puisse modifier la façon dont il utilise l’énergie et stocke les informations au fur et à mesure de son apprentissage, de la même manière que le fonctionnement du cerveau humain.

- Bande passante de données élevée (pour un apprentissage rapide) et grande empreinte mémoire.

- Communication sur puce pour promouvoir la fiabilité et la disponibilité.

« Le processus visant à relever ces défis ne fait que commencer dans un certain nombre de disciplines scientifiques. Et cela nécessitera probablement une collaboration très étroite entre ces disciplines, ainsi qu’une ouverture à de nouvelles conceptions et à de nouveaux matériaux », explique Yanguas-Gil. « C’est une période extrêmement excitante pour l’ensemble de l’écosystème de l’apprentissage tout au long de la vie. »