Réunir les supercalculateurs et les expériences pour accélérer les découvertes

L’intégration transparente des installations expérimentales à grande échelle du DOE et de ses puissantes ressources informatiques aidera les chercheurs à suivre le rythme de l’afflux toujours croissant de données scientifiques.

Lorsque la mise à niveau massive de la source de photons avancée (APS) du laboratoire national d’Argonne du ministère américain de l’Énergie (DOE) sera achevée plus tard cette année, les expériences sur la puissante source de lumière à rayons X devraient générer 100 à 200 pétaoctets, soit 100 -200 millions de gigaoctets de données scientifiques par an.

Il s’agit d’une augmentation substantielle par rapport aux environ cinq pétaoctets produits chaque année à l’APS, une installation utilisateur du Bureau des sciences du DOE à Argonne, avant la mise à niveau. Et si l’on considère les quatre autres sources lumineuses du DOE, les installations devraient produire un exaoctet, soit 1 milliard de gigaoctets, de données par an au cours de la décennie à venir.

« Un exaoctet de données équivaut à diffuser 1,5 million de films chaque jour pendant un an », a déclaré Nicholas Schwarz, informaticien d’Argonne et responsable des logiciels scientifiques et de la gestion des données à l’APS.

« Mais nous devons faire bien plus que simplement déplacer un grand nombre de données. Pour les expériences de rayons X réalisées à l’APS, nous devons utiliser des outils informatiques avancés pour examiner chaque pixel de chaque image, analyser les données dans en temps quasi réel et utiliser les résultats pour prendre des décisions concernant la prochaine expérience. »

« Pour traiter toutes ces données rapidement, nous avons besoin de nombreuses capacités informatiques, depuis les gros ordinateurs et le stockage de données jusqu’aux logiciels d’analyse, en passant par le tissu informatique qui relie toutes ces ressources entre elles », a-t-il ajouté.

Le déluge croissant de données scientifiques n’est pas propre aux sources lumineuses. Les télescopes, les accélérateurs de particules, les installations de recherche sur la fusion, les capteurs à distance et autres instruments scientifiques produisent également de grandes quantités de données. Et à mesure que leurs capacités s’améliorent au fil du temps, les taux de génération de données ne feront qu’augmenter.

« La capacité de la communauté scientifique à traiter, analyser, stocker et partager ces ensembles de données massifs est essentielle pour obtenir des informations qui déclencheront de nouvelles découvertes », a déclaré Michael E. Papka, directeur adjoint du laboratoire associé d’Argonne pour l’informatique, l’environnement et les sciences de la vie.

Papka est également directeur de l’Argonne Leadership Computing Facility (ALCF), une installation utilisateur du DOE Office of Science à Argonne, et est professeur d’informatique à l’Université de l’Illinois à Chicago.

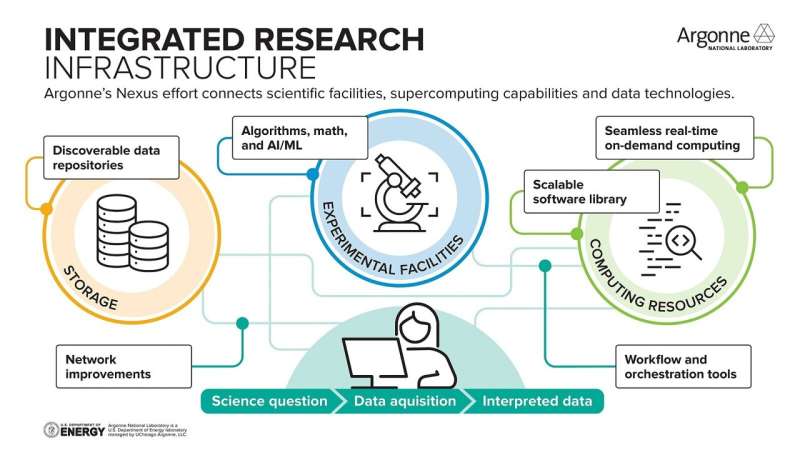

L’effort Nexus d’Argonne joue un rôle central dans la progression de la vision du DOE visant à construire une infrastructure de recherche intégrée (IRI). Le développement d’un IRI accélérerait la recherche à forte intensité de données en intégrant de manière transparente les installations expérimentales de pointe du DOE avec ses ressources de calcul intensif, d’intelligence artificielle (IA) et de données de classe mondiale.

Depuis plus d’une décennie, Argonne travaille au développement d’outils et de méthodes permettant de connecter ses puissantes ressources informatiques à des expériences à grande échelle. La fusion des supercalculateurs ALCF avec l’APS a constitué un objectif important des recherches du laboratoire liées à l’IRI, mais les travaux ont également inclus des collaborations avec le centre national de fusion DIII-D en Californie et le grand collisionneur de hadrons du CERN en Suisse. DIII-D est une installation utilisateur du DOE Office of Science hébergée par General Atomics.

« Nous travaillons en partenariat avec des installations expérimentales depuis plusieurs années maintenant pour les aider à utiliser nos ressources de supercalcul afin de traiter plus rapidement d’énormes quantités de données », a déclaré Papka. « Avec le lancement de Nexus, nous disposons d’un véhicule pour coordonner toutes nos recherches et collaborations dans cet espace afin de nous aligner sur les efforts plus larges du DOE pour diriger la nouvelle ère de la science intégrée. »

Les travaux en cours d’Argonne ont conduit à la création d’outils pour gérer les flux de travail informatiques et au développement de nouvelles capacités pour l’informatique à la demande, donnant au laboratoire une expérience précieuse pour soutenir l’initiative DOE IRI. Globus et l’ALCF Community Data Co-Op (ACDC) sont des ressources essentielles pour concrétiser la vision de l’IRI.

Globus, une plate-forme d’automatisation de la recherche créée par des chercheurs d’Argonne et de l’Université de Chicago, est utilisée pour gérer les transferts de données à grande vitesse, les flux de travail informatiques, la collecte de données et d’autres tâches expérimentales. ACDC offre des capacités de stockage de données à grande échelle, offrant un portail qui facilite le partage de données avec des collaborateurs externes à travers le monde.

Le prochain supercalculateur exascale Aurora de l’ALCF renforcera également les efforts IRI du laboratoire, en fournissant une augmentation significative de la puissance de calcul et des capacités avancées pour l’IA et l’analyse des données.

Rationaliser la science

L’IRI permettra non seulement aux expériences d’analyser de grandes quantités de données, mais également de traiter rapidement de grands ensembles de données pour obtenir des résultats rapides. Ceci est crucial car l’analyse au moment de l’expérience joue souvent un rôle clé dans l’élaboration des expériences ultérieures.

Pour la collaboration Argonne-DIII-D, les chercheurs ont démontré comment l’intégration étroite des supercalculateurs ALCF pourrait bénéficier à une configuration expérimentale rapide. Leurs travaux étaient centrés sur une expérience de fusion utilisant une série d’impulsions de plasma, ou tirs, pour étudier le comportement des plasmas dans des conditions contrôlées.

Les tirs se produisaient toutes les 20 minutes, mais l’analyse des données nécessitait plus de 20 minutes en utilisant leurs ressources informatiques locales, de sorte que les résultats n’étaient pas disponibles à temps pour éclairer le tir suivant. Les chercheurs du DIII-D se sont associés à l’ALCF pour explorer comment ils pourraient exploiter les superordinateurs pour accélérer le processus d’analyse.

« Chaque fois qu’ils prenaient une photo, nous commencions un travail à l’ALCF. Il récupérait les données du DIII-D, effectuait l’analyse et leur renvoyait les résultats à temps pour calibrer la photo suivante », a déclaré Thomas Uram, Argonne. informaticien et responsable IRI à l’ALCF.

« Comme nous disposions de plus de puissance de calcul que celle dont DIII-D disposait localement, nous pouvions analyser leurs données plus rapidement et avec une résolution 16 fois supérieure à celle de leurs systèmes internes. Non seulement ils ont obtenu les résultats avant la prise de vue suivante, mais ils Nous avons également obtenu des analyses à résolution nettement plus élevée pour améliorer la précision de leur configuration. »

De nombreuses expériences menées à l’APS bénéficieront également d’une analyse de données en temps quasi réel, notamment la recherche sur les batteries, l’exploration des défaillances des matériaux et le développement de médicaments.

« En obtenant les résultats d’analyse en quelques secondes ou moins au lieu d’heures, de jours ou même de semaines, les scientifiques peuvent obtenir un aperçu en temps réel de leurs expériences au fur et à mesure qu’elles se déroulent », a déclaré Schwarz. « Les chercheurs pourront utiliser ces informations pour piloter une expérience et zoomer sur une zone particulière afin de visualiser les processus critiques, tels que les changements moléculaires qui se produisent au cours des cycles de charge et de décharge d’une batterie, au fur et à mesure qu’ils se produisent. »

Une IRI pleinement réalisée aurait également un impact sur les personnes menant la recherche. Les scientifiques doivent souvent consacrer beaucoup de temps et d’efforts à la gestion des données lorsqu’ils mènent une expérience. Cela inclut des tâches telles que le stockage, le transfert, la validation et le partage des données avant qu’elles puissent être utilisées pour obtenir de nouvelles informations.

« La vision de l’IRI est d’automatiser bon nombre de ces tâches fastidieuses de gestion des données afin que les chercheurs puissent se concentrer davantage sur la science », a déclaré Uram. « Cela rationaliserait considérablement le processus scientifique, libérant ainsi les scientifiques et leur laissant plus de temps pour formuler des hypothèses pendant que les expériences sont en cours. »

Calcul intensif à la demande

Obtenir un accès instantané aux supercalculateurs du DOE pour l’analyse des données nécessite un changement dans le fonctionnement des installations informatiques. Chaque installation a établi des politiques et des processus pour accéder aux machines, créer des comptes d’utilisateurs, gérer les données et d’autres tâches.

« Si un chercheur est installé dans une installation informatique mais doit utiliser des superordinateurs dans d’autres installations, il devra à nouveau suivre un ensemble d’étapes similaires pour chaque site », a déclaré Uram. « Et cela prend du temps. Cela enlève du temps à la véritable science. »

Une fois le projet mis en place, les chercheurs soumettent leur « travail » à une file d’attente, où ils attendent leur tour pour s’exécuter sur le supercalculateur. Même si le système de file d’attente traditionnel permet d’optimiser l’utilisation des superordinateurs dans les installations, il ne prend pas en charge les délais d’exécution rapides nécessaires à l’IRI.

Pour faciliter la tâche des utilisateurs finaux, l’IRI nécessitera la mise en œuvre d’un moyen uniforme permettant aux équipes expérimentales d’accéder rapidement aux ressources de supercalcul du DOE.

À cette fin, Argonne a développé et démontré des méthodes permettant de surmonter à la fois les défis liés aux comptes utilisateur et à la planification des tâches. La colocalisation de l’APS et de l’ALCF sur le campus d’Argonne offre un environnement idéal pour tester et démontrer de telles capacités.

Lorsque l’ALCF a lancé le supercalculateur Polaris en 2022, quatre des racks du système étaient dédiés à l’avancement des efforts d’intégration avec les installations expérimentales.

Dans le cas des comptes d’utilisateurs, le processus existant peut s’avérer fastidieux pour les expériences impliquant plusieurs membres de l’équipe qui doivent utiliser les installations informatiques pour le traitement des données. L’équipe Argonne a piloté l’idée d’utiliser des « comptes de service » qui fournissent un accès sécurisé à une expérience particulière au lieu d’exiger que chaque membre de l’équipe ait un compte actif.

« C’est important car de nombreuses expériences nécessitent une équipe de personnes collectant des données et exécutant des tâches d’analyse sur une période de quelques jours ou d’une semaine », a déclaré Uram. « Nous avons besoin d’un moyen de soutenir l’expérience indépendamment de la personne qui utilise les instruments ce jour-là. »

Pour résoudre le problème de planification des tâches, l’équipe Argonne a réservé une partie des nœuds Polaris pour qu’ils fonctionnent avec des files d’attente « à la demande » et « préemptables ». Cette approche permet d’exécuter immédiatement les tâches urgentes sur les nœuds dédiés.

L’équipe a réalisé avec succès des tests des comptes de service et des files d’attente à la demande et préemptables sur Polaris en utilisant les données générées lors d’une expérience APS. Les courses étaient entièrement automatisées, sans aucun humain dans la boucle.

« Cette capacité est vraiment passionnante pour les efforts d’intégration expérimentale ici à Argonne, mais il reste beaucoup de travail à faire pour développer des solutions réalisables pouvant être utilisées dans toutes les installations expérimentales et informatiques du DOE », a déclaré Papka.

Rassembler tout cela

Alors qu’Argonne et ses collègues laboratoires nationaux travaillent depuis plusieurs années sur des projets visant à démontrer la promesse d’un paradigme de recherche intégré, le programme Advanced Scientific Computing Research (ASCR) du DOE en a fait une initiative plus formelle en 2020 avec le lancement de l’IRI. Force d’intervention.

Composé de membres de plusieurs laboratoires nationaux, dont Schwarz, Uram, Jini Ramprakash et Corey Adams d’Argonne, le groupe de travail a identifié les opportunités, les risques et les défis posés par une telle intégration.

En 2022, l’ASCR a lancé l’activité IRI Blueprint pour créer un cadre de mise en œuvre de l’IRI. L’équipe du projet, qui comprenait Schwarz et Ramprakash, a publié un rapport décrivant la voie à suivre depuis les partenariats et démonstrations individuels du laboratoire vers une stratégie plus large à long terme qui fonctionnera dans l’ensemble de l’écosystème du DOE.

Au cours de l’année écoulée, les activités du plan ont commencé à se formaliser avec l’introduction des ressources et des environnements de test de l’IRI. Désormais en place dans chacune des installations informatiques du DOE, les bancs d’essai facilitent la recherche pour explorer et affiner les idées de l’IRI en collaboration avec les équipes des installations expérimentales du DOE.

« Avec le lancement de l’effort Nexus ici à Argonne, nous continuerons à tirer parti de nos connaissances, expertises et ressources collectives pour aider le DOE et la communauté scientifique dans son ensemble à activer et à faire évoluer ce nouveau paradigme dans un large éventail de domaines de recherche, d’instruments scientifiques et d’utilisateurs. installations », a déclaré Uram.