Une recherche montre que l’intelligence artificielle échoue en grammaire

Une étude menée par des chercheurs de l’UAB et de l’URV et publiée dans PNAS montre que les êtres humains reconnaissent les erreurs grammaticales dans une phrase, contrairement à l’IA. Les chercheurs ont comparé les compétences des humains et les trois meilleurs grands modèles de langage actuellement disponibles.

La langue est l’une des principales caractéristiques qui différencient les êtres humains des autres espèces. Son origine, comment il est appris et pourquoi les gens ont pu développer un système de communication aussi complexe ont soulevé de nombreuses questions pour les linguistes et les chercheurs d’une grande variété de domaines de recherche.

Ces dernières années, des progrès considérables ont été réalisés dans l’enseignement du langage informatique, ce qui a conduit à l’émergence de ce que l’on appelle les grands modèles de langage, des technologies entraînées avec d’énormes quantités de données qui sont à la base de certaines applications d’intelligence artificielle (IA). : par exemple, les moteurs de recherche, les traducteurs automatiques ou les convertisseurs audio-texte.

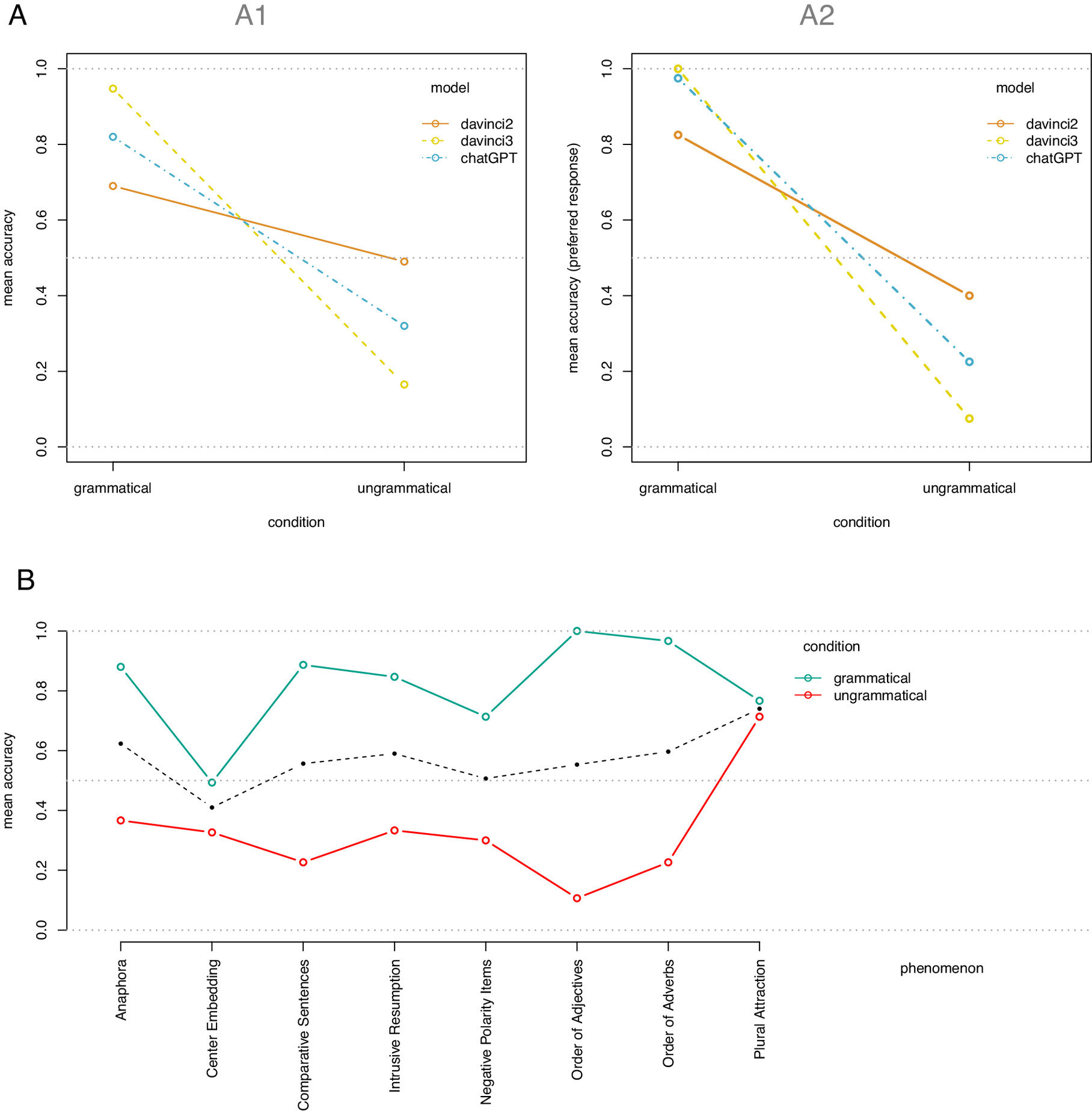

Mais quelles sont les compétences linguistiques de ces modèles ? Peuvent-ils être comparés à ceux d’un être humain ? Une équipe de recherche dirigée par l’URV avec la participation de l’Université Humboldt de Berlin, de l’Université autonome de Barcelone (UAB) et de l’Institut catalan de recherche et d’études avancées (ICREA) a testé ces systèmes pour vérifier si leurs compétences linguistiques peuvent être comparées à ceux des gens. Pour ce faire, ils ont comparé les compétences des humains et les trois meilleurs grands modèles de langage actuellement disponibles : deux basés sur GPT3 et un (ChatGPT) basé sur GP3.5.

On leur a confié une tâche simple : il leur a été demandé de déterminer sur place si une grande variété de phrases étaient grammaticalement bien formées dans leur langue maternelle. Les humains qui ont participé à cette expérience et les modèles de langage se sont vu poser une question très simple : « Cette phrase est-elle grammaticalement correcte ?

Les résultats ont montré que les humains répondaient correctement, alors que les grands modèles de langage donnaient de nombreuses réponses fausses. En fait, ils ont adopté une stratégie par défaut consistant à répondre « oui » la plupart du temps, que la réponse soit correcte ou non.

« Le résultat est surprenant, puisque ces systèmes sont formés sur la base de ce qui est grammaticalement correct ou non dans une langue », explique Vittoria Dentella, chercheuse au Département d’études anglaises et allemandes, qui a dirigé l’étude. Les évaluateurs humains forment explicitement ces grands modèles de langage sur la grammaticalité des constructions qu’ils peuvent rencontrer.

Grâce à un processus d’apprentissage renforcé par le feedback humain, ces modèles reçoivent des exemples de phrases mal grammaticalement construites puis la version correcte. Ce type d’enseignement constitue un élément fondamental de leur « formation ». En revanche, ce n’est pas le cas chez l’homme. « Bien que les personnes qui élèvent un bébé corrigent occasionnellement sa façon de parler, elles ne le font pas constamment dans aucune communauté linguistique du monde », dit-elle.

L’étude révèle donc qu’il existe une double inadéquation entre les humains et l’IA. Les gens n’ont pas accès à des « preuves négatives » – sur ce qui n’est pas grammaticalement correct dans la langue parlée – contrairement aux grands modèles de langage, grâce à la rétroaction humaine. Mais malgré cela, les modèles ne peuvent pas reconnaître les erreurs grammaticales triviales, alors que les humains le peuvent instantanément et sans effort.

» Développer des outils d’intelligence artificielle utiles et sûrs peut être très utile, mais nous devons être conscients de leurs lacunes. Étant donné que la plupart des applications d’IA dépendent de la compréhension des commandes données en langage naturel, déterminer leur compréhension limitée de la grammaire, comme nous l’avons fait dans cette étude. , est d’une importance vitale », note Evelina Leivada, professeur de recherche ICREA au Département d’études catalanes de l’UAB.

« Ces résultats suggèrent que nous devons réfléchir de manière critique à la question de savoir si les IA possèdent réellement des compétences linguistiques similaires à celles des humains », conclut Dentella, qui considère que l’adoption de ces modèles de langage comme théories du langage humain n’est pas justifiée à leur stade actuel de développement.